二进制搭建 Kubernetes v1.20

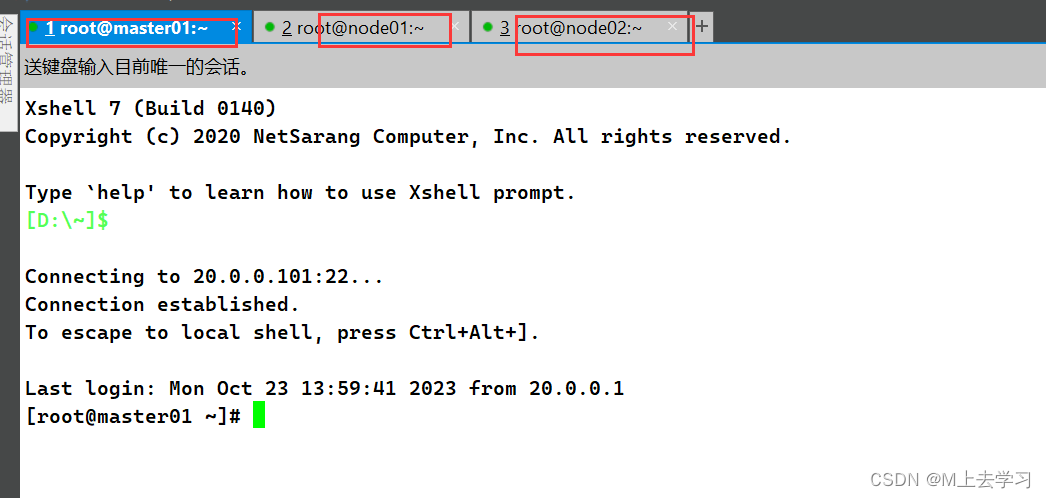

k8s集群master01:20.0.0.101 kube-apiserver kube-controller-manager kube-scheduler etcd

k8s集群master02:20.0.0.106

k8s集群node01:20.0.0.102 kubelet kube-proxy docker

k8s集群node02:20.0.0.103

etcd集群节点1:20.0.0.101 etcd

etcd集群节点2:20.0.0.102 etcd

etcd集群节点3:20.0.0.103 etcd

负载均衡nginx+keepalive01(master):20.0.0.104

负载均衡nginx+keepalive02(backup):20.0.0.105

VIP 20.0.0.100

------------------------------ 操作系统初始化配置 ------------------------------

#关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

#关闭selinux

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

#关闭swap

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab

#根据规划设置主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

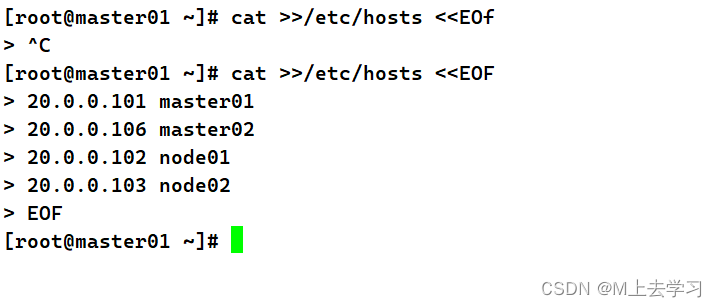

#在master添加hosts

cat >> /etc/hosts << EOF

20.0.0.101 master01

20.0.0.106 master02

20.0.0.102 node01

20.0.0.103 node02

EOF

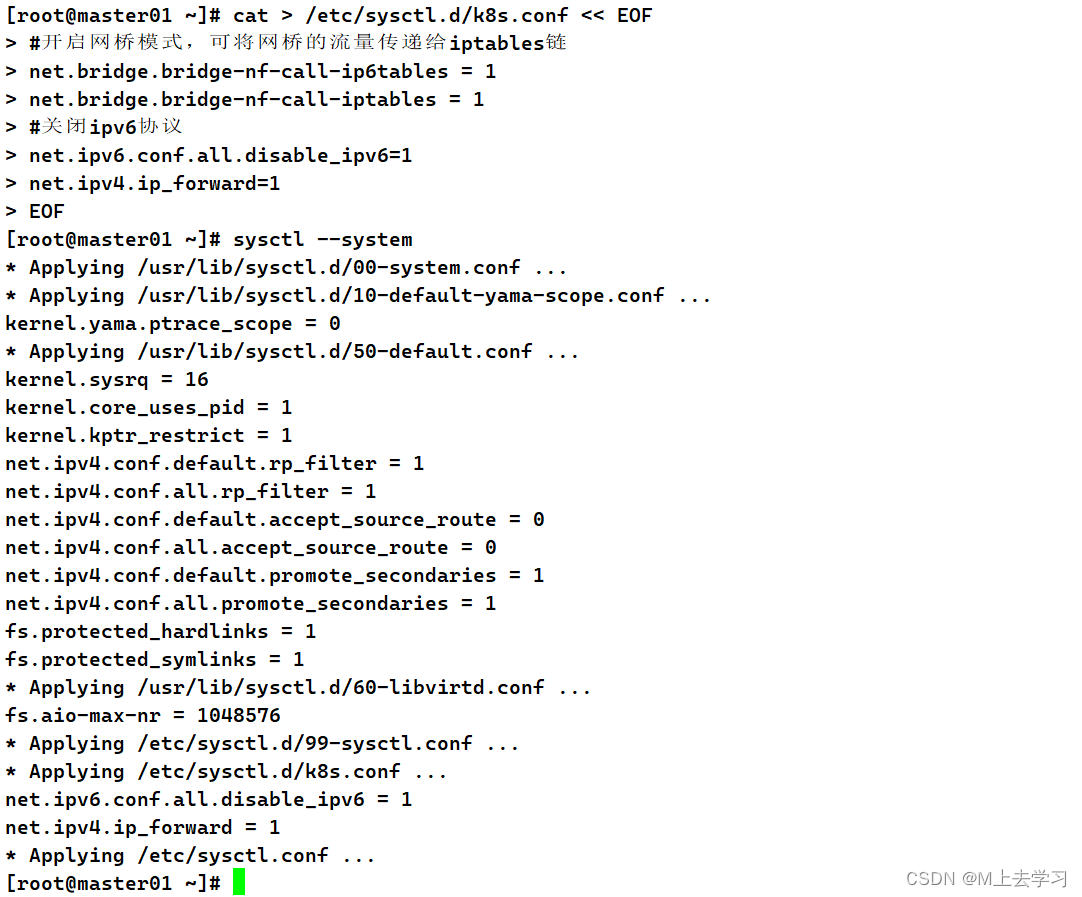

#调整内核参数

cat > /etc/sysctl.d/k8s.conf << EOF

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

#关闭ipv6协议

net.ipv6.conf.all.disable_ipv6=1

net.ipv4.ip_forward=1

EOF

#将系统的默认内核参数配置文件和 "/etc/sysctl.d/" 目录中的配置文件加载到内核中,使之生效。

sysctl --system

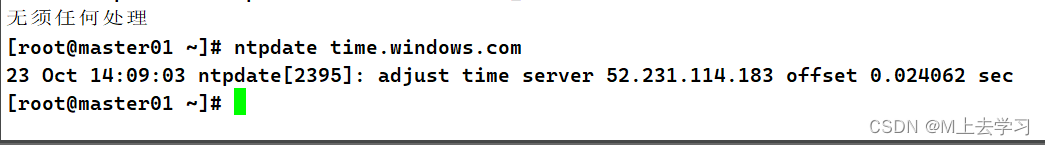

#时间同步(每个机器都装)

#安装时间同步工具

yum install ntpdate -y

ntpdate time.windows.com

------------------------------ 部署 docker引擎 ------------------------------

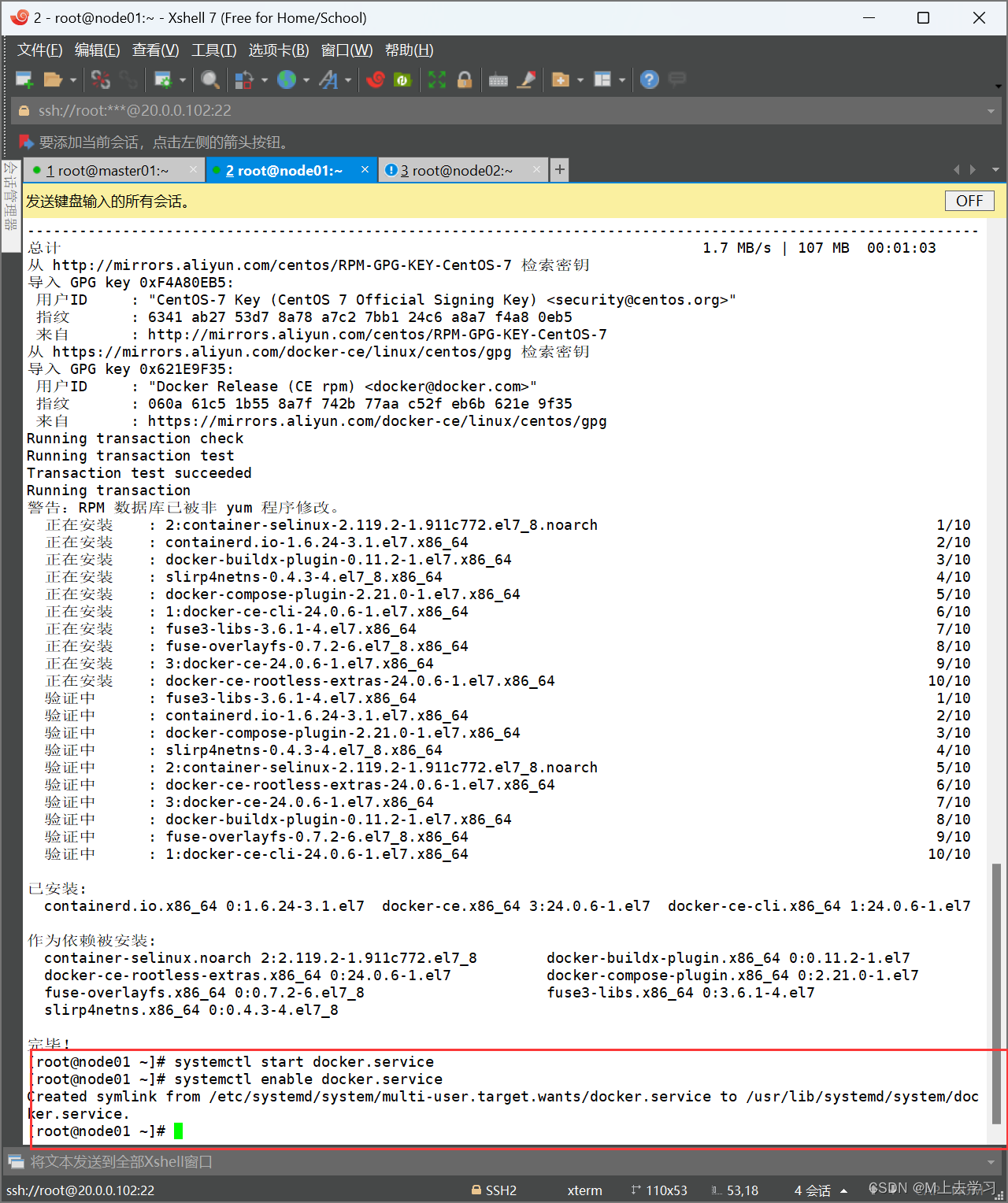

//所有 node 节点部署docker引擎

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

#启动docker服务

systemctl start docker.service

#开机自启docker服务

systemctl enable docker.service

------------------------------ 部署 etcd 集群 ------------------------------

etcd是CoreOS团队于2013年6月发起的开源项目,它的目标是构建一个高可用的分布式键值(key-value)数据库。etcd内部采用raft协议作为一致性算法,etcd是go语言编写的。

etcd 作为服务发现系统,有以下的特点:

简单:安装配置简单,而且提供了HTTP API进行交互,使用也很简单

安全:支持SSL证书验证

快速:单实例支持每秒2k+读操作

可靠:采用raft算法,实现分布式系统数据的可用性和一致性

etcd 目前默认使用2379端口提供HTTP API服务, 2380端口和peer通信(这两个端口已经被IANA(互联网数字分配机构)官方预留给etcd)。 即etcd默认使用2379端口对外为客户端提供通讯,使用端口2380来进行服务器间内部通讯。

etcd 在生产环境中一般推荐集群方式部署。由于etcd 的leader选举机制,要求至少为3台或以上的奇数台。

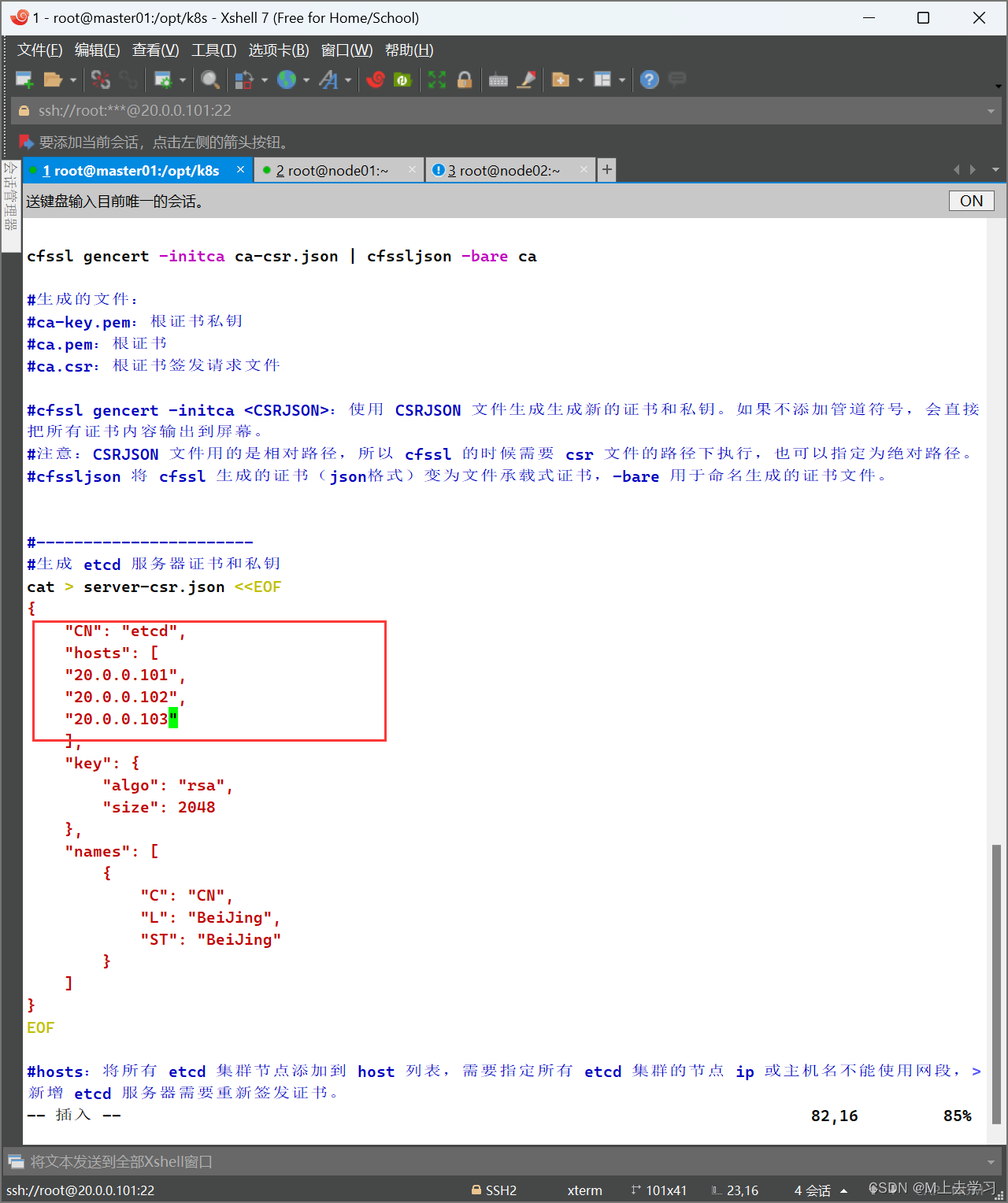

---------- 准备签发证书环境 ----------

CFSSL 是 CloudFlare 公司开源的一款 PKI/TLS 工具。 CFSSL 包含一个命令行工具和一个用于签名、验证和捆绑 TLS 证书的 HTTP API 服务。使用Go语言编写。

CFSSL 使用配置文件生成证书,因此自签之前,需要生成它识别的 json 格式的配置文件,CFSSL 提供了方便的命令行生成配置文件。

CFSSL 用来为 etcd 提供 TLS 证书,它支持签三种类型的证书:

1、client 证书,服务端连接客户端时携带的证书,用于客户端验证服务端身份,如 kube-apiserver 访问 etcd;

2、server 证书,客户端连接服务端时携带的证书,用于服务端验证客户端身份,如 etcd 对外提供服务;

3、peer 证书,相互之间连接时使用的证书,如 etcd 节点之间进行验证和通信。

这里全部都使用同一套证书认证。

//在 master01 节点上操作

#准备cfssl证书生成工具(或者下载好后将所需的包传入指定位置)

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl*

------------------------------------------------------------------------------------------

cfssl:证书签发的工具命令

cfssljson:将 cfssl 生成的证书(json格式)变为文件承载式证书

cfssl-certinfo:验证证书的信息

cfssl-certinfo -cert <证书名称> #查看证书的信息

------------------------------------------------------------------------------------------

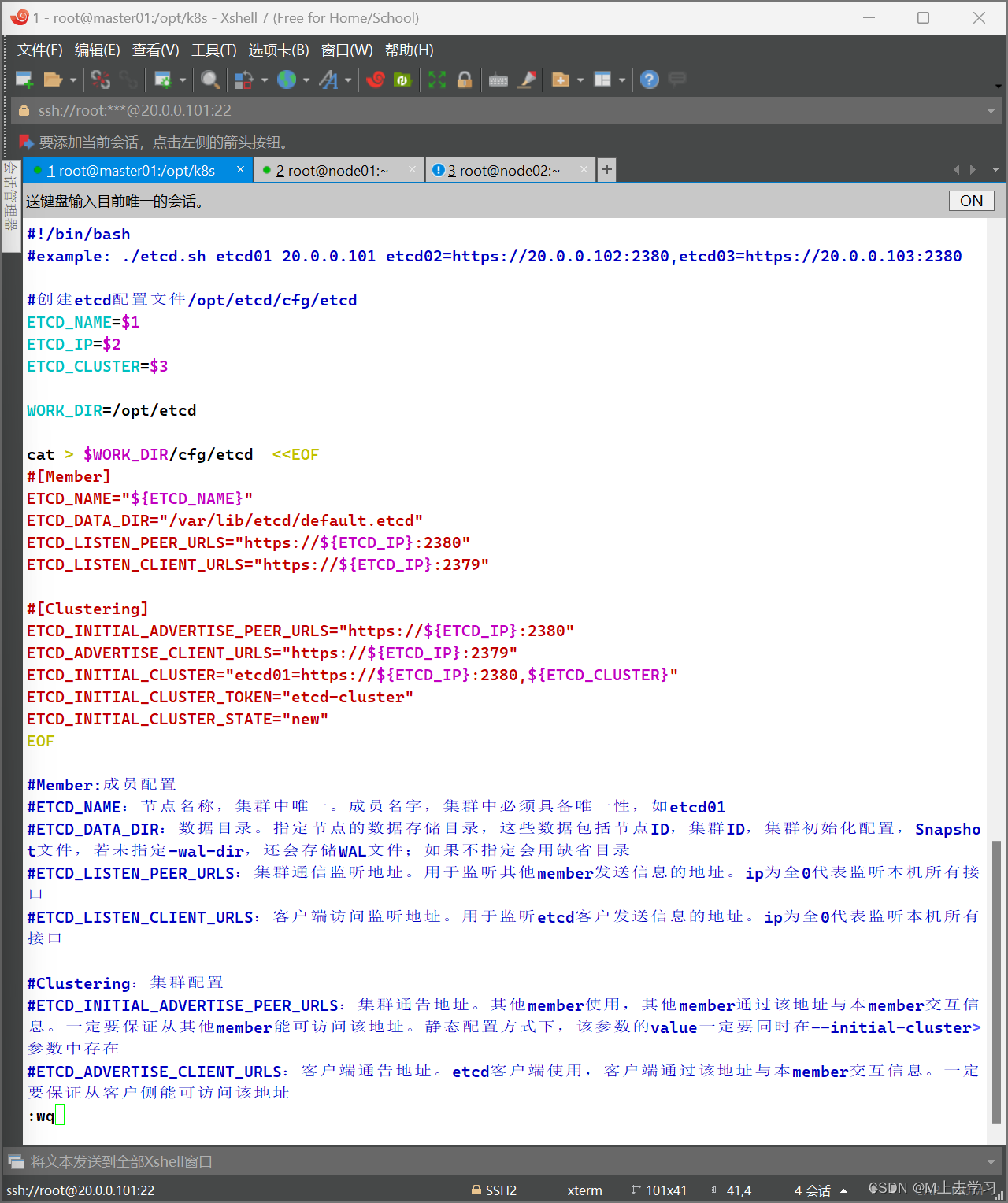

生成Etcd证书 ###

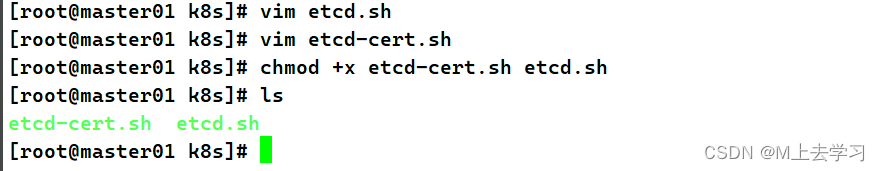

mkdir /opt/k8s

cd /opt/k8s/

#上传 etcd-cert.sh 和 etcd.sh 到 /opt/k8s/ 目录中 (注意要修改etcd-cert.sh文件ip地址)

chmod +x etcd-cert.sh etcd.sh

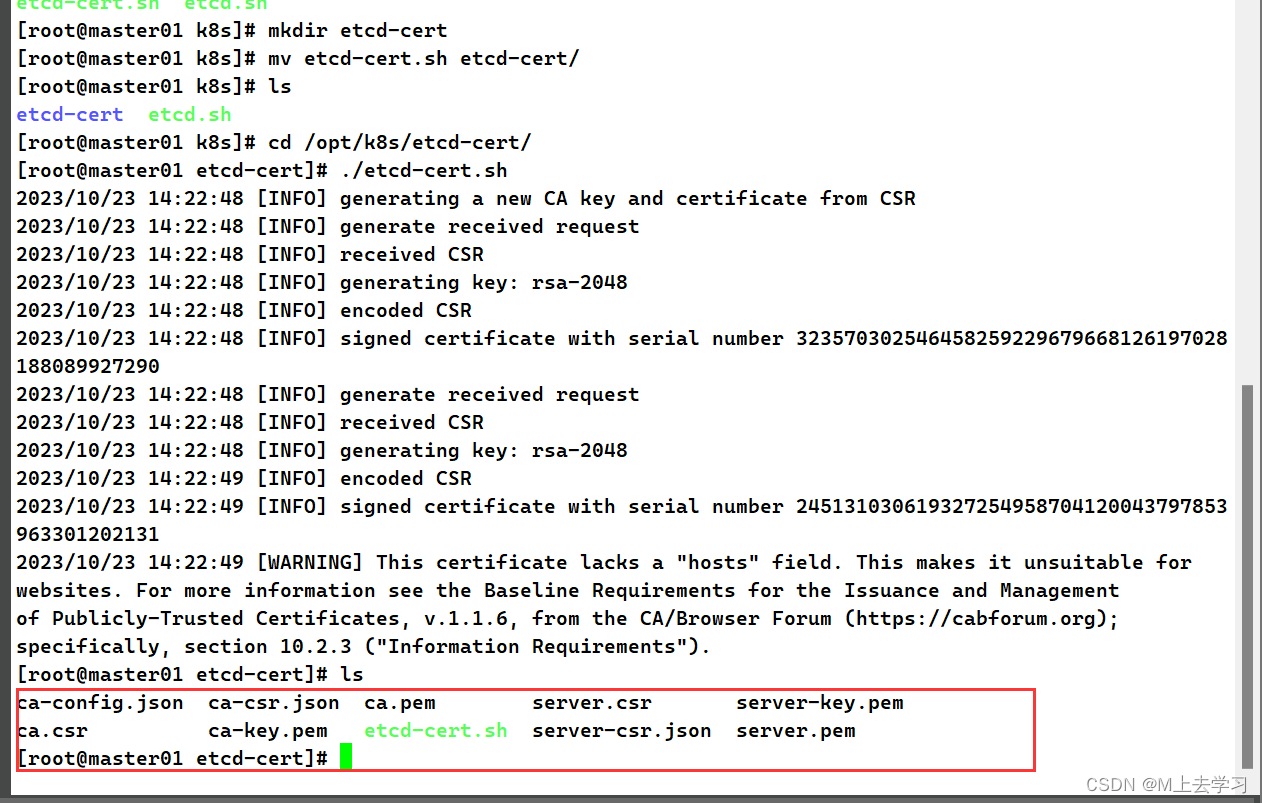

#创建用于生成CA证书、etcd 服务器证书以及私钥的目录

mkdir /opt/k8s/etcd-cert

mv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh #生成CA证书、etcd 服务器证书以及私钥

ls 查看/opt/k8s/etcd-cert下生成的证书 文件

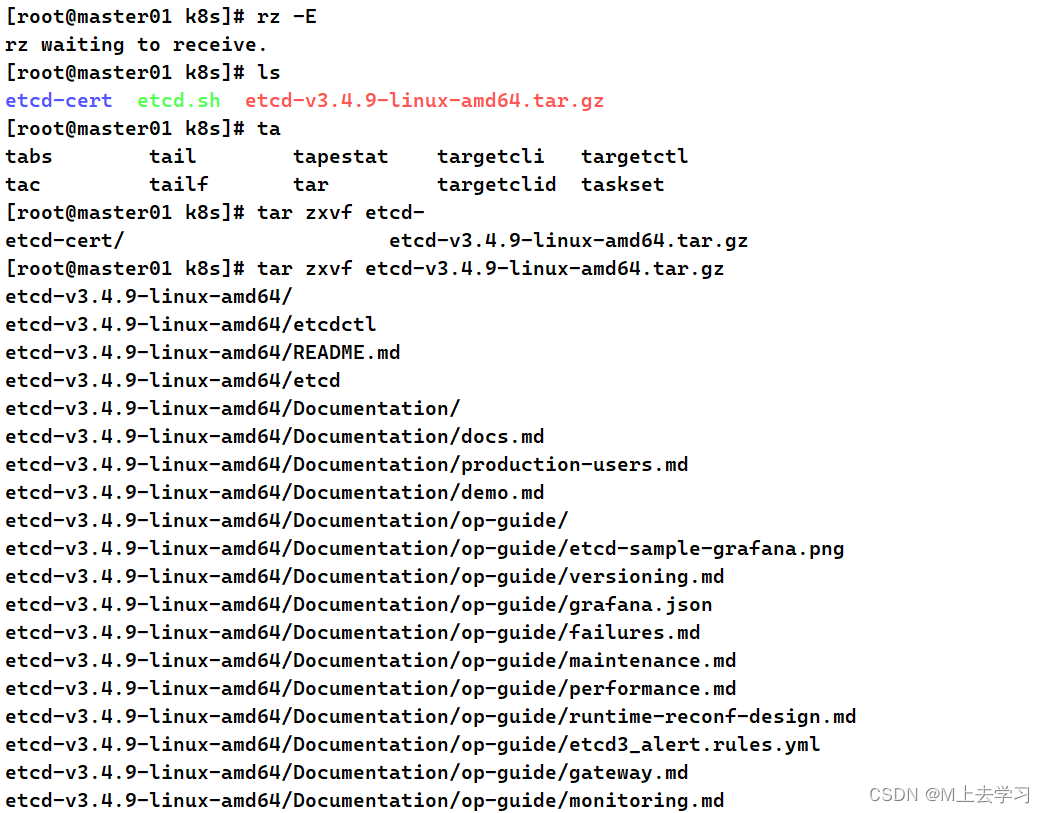

#上传 etcd-v3.4.9-linux-amd64.tar.gz 到 /opt/k8s 目录中,启动etcd服务

https://github.com/etcd-io/etcd/releases/download/v3.4.9/etcd-v3.4.9-linux-amd64.tar.gz

cd /opt/k8s/

tar zxvf etcd-v3.4.9-linux-amd64.tar.gz

ls etcd-v3.4.9-linux-amd64

------------------------------------------------------------------------------------------

etcd就是etcd 服务的启动命令,后面可跟各种启动参数

etcdctl主要为etcd 服务提供了命令行操作

------------------------------------------------------------------------------------------

#创建用于存放 etcd 配置文件,命令文件,证书的目录:

#创建一个名为 "/opt/etcd" 的目录,并在该目录下创建三个子目录,分别是 "cfg"、"bin" 和 "ssl"。

mkdir -p /opt/etcd/{cfg,bin,ssl}

cd /opt/k8s/etcd-v3.4.9-linux-amd64/

#将当前目录下的 "etcd" 和 "etcdctl" 文件移动到 "/opt/etcd/bin/" 目录中。**加粗样式**

mv etcd etcdctl /opt/etcd/bin/

#将 "/opt/k8s/etcd-cert/" 目录下的所有以 ".pem" 结尾的文件复制到 "/opt/etcd/ssl/" 目录中。

cp /opt/k8s/etcd-cert/*.pem /opt/etcd/ssl/

cd /opt/k8s/

./etcd.sh etcd01 20.0.0.101 etcd02=https://20.0.0.102:2380,etcd03=https://20.0.0.103:2380

#进入卡住状态等待其他节点加入,这里需要三台etcd服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有etcd节点都已启动,可忽略这个情况

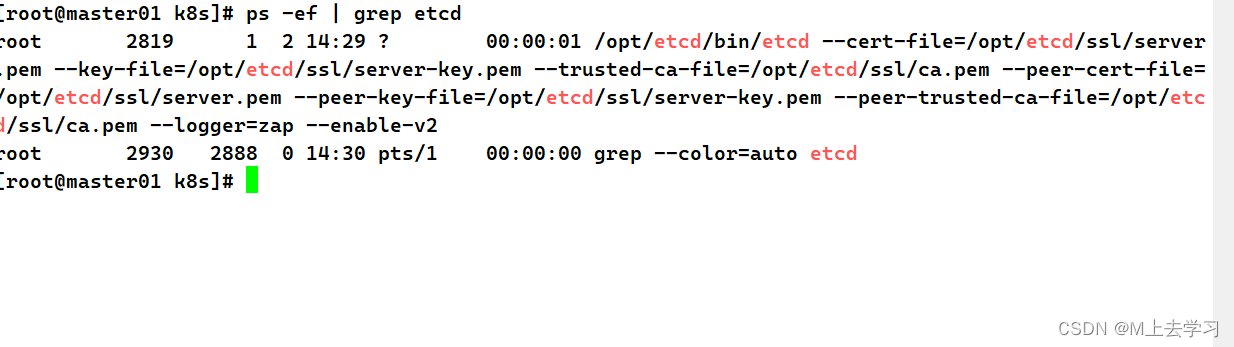

#可另外打开一个窗口查看etcd进程是否正常

ps -ef | grep etcd

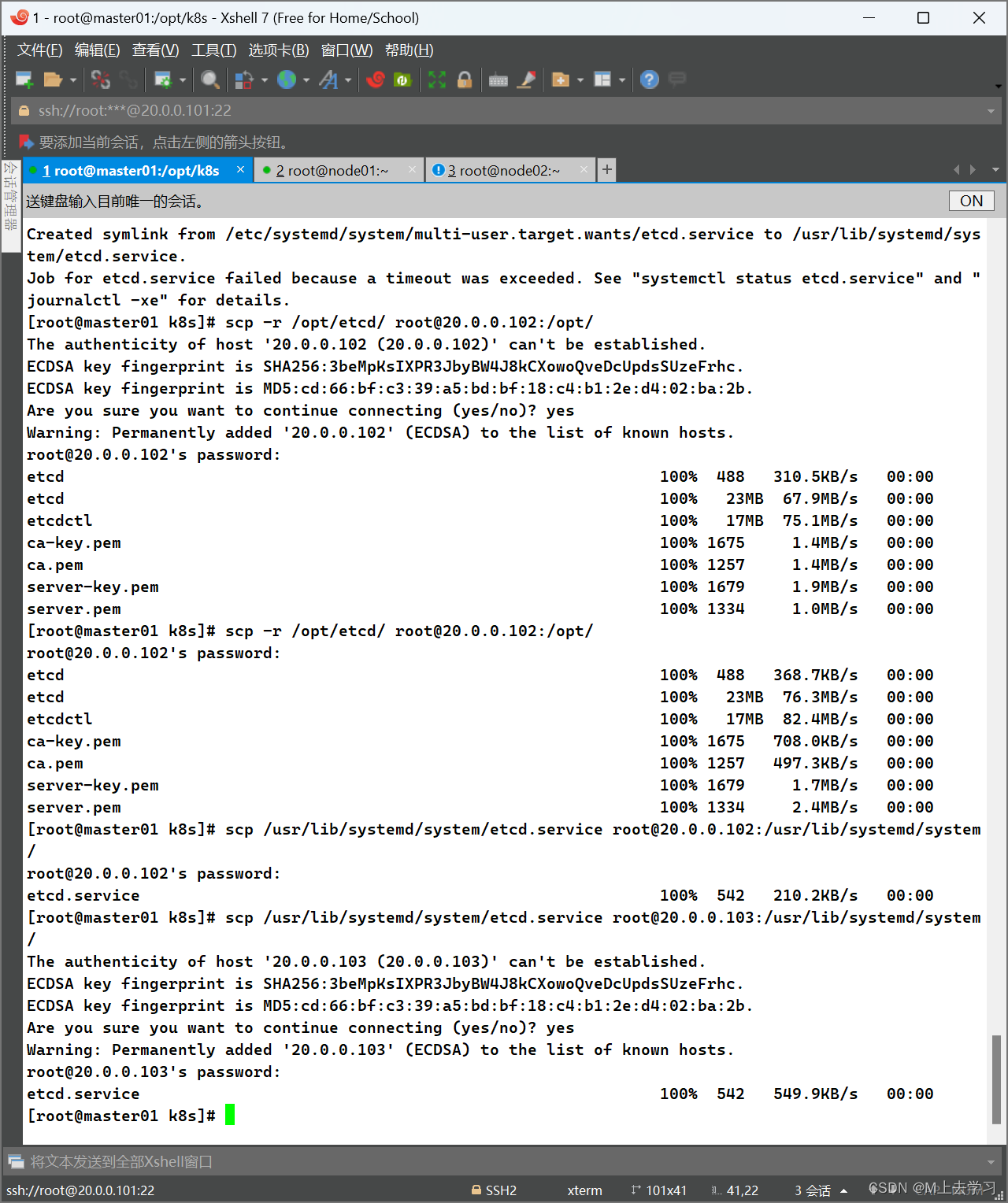

#把etcd相关证书文件、命令文件和服务管理文件全部拷贝到另外两个etcd集群节点

scp -r /opt/etcd/ root@20.0.0.102:/opt/

scp -r /opt/etcd/ root@20.0.0.103:/opt/

scp /usr/lib/systemd/system/etcd.service root@20.0.0.102:/usr/lib/systemd/system/

scp /usr/lib/systemd/system/etcd.service root@20.0.0.103:/usr/lib/systemd/system/

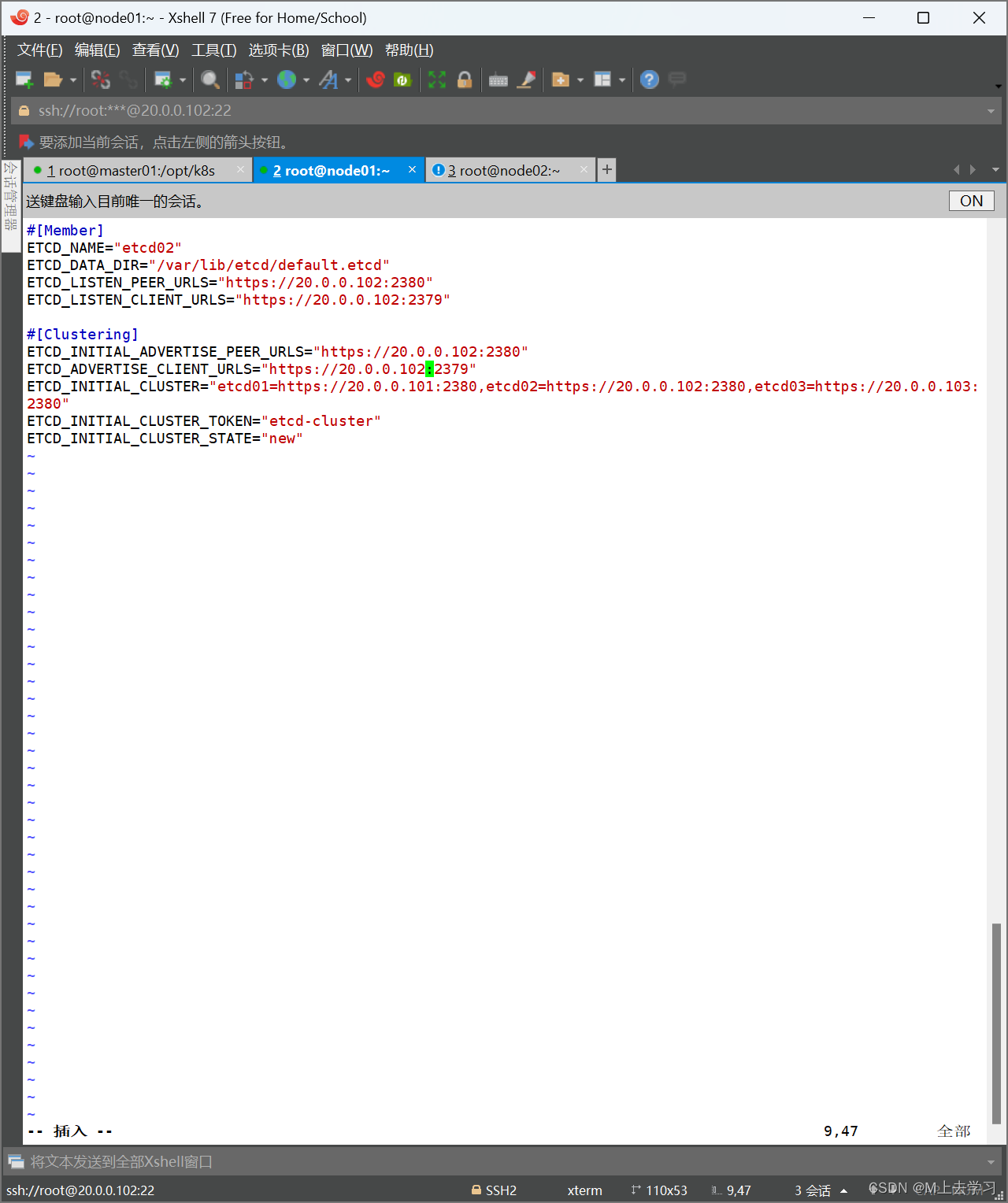

//在 node01 节点上操作

vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd02" #修改

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://20.0.0.102:2380" #修改

ETCD_LISTEN_CLIENT_URLS="https://20.0.0.102:2379" #修改

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://20.0.0.102:2380" #修改

ETCD_ADVERTISE_CLIENT_URLS="https://20.0.0.102:2379" #修改

ETCD_INITIAL_CLUSTER="etcd01=https://20.0.0.101:2380,etcd02=https://20.0.0.102:2380,etcd03=https://20.0.0.103:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

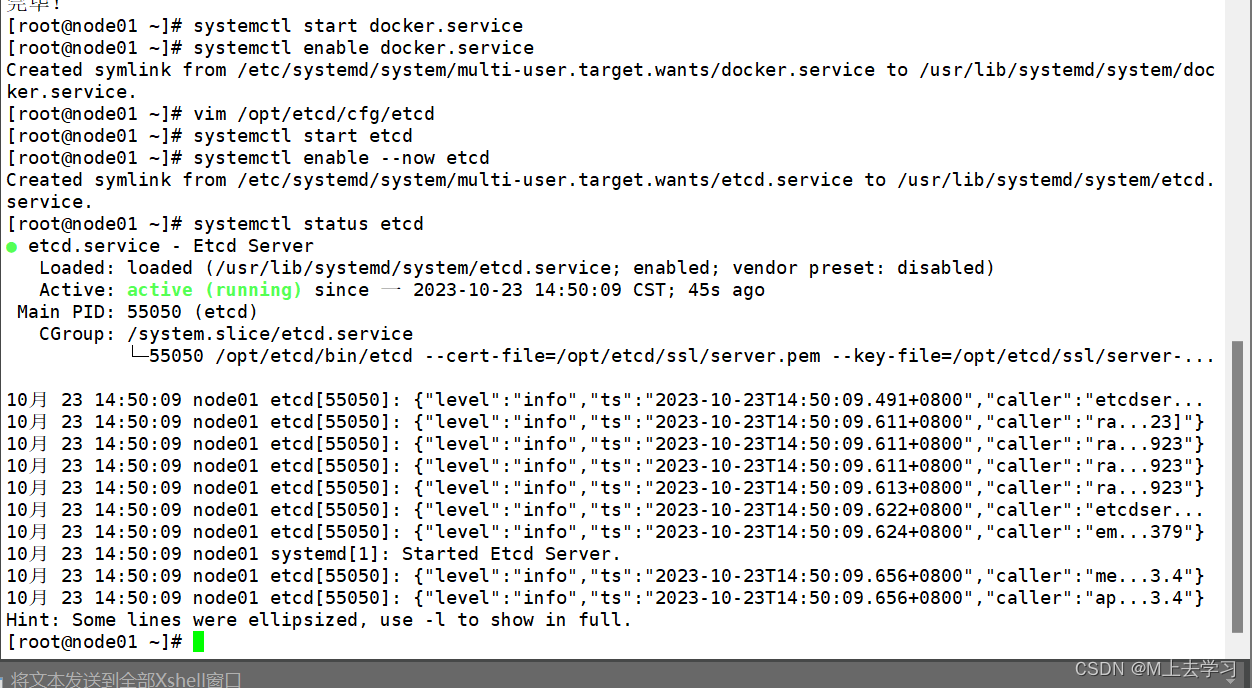

#启动etcd服务

systemctl start etcd

systemctl enable etcd ##systemctl enable --now etcd 立即启动

systemctl在enable、disable、mask子命令里面增加了--now选项,可以激活同时启动服务,激活同时停止服务等。

systemctl status etcd

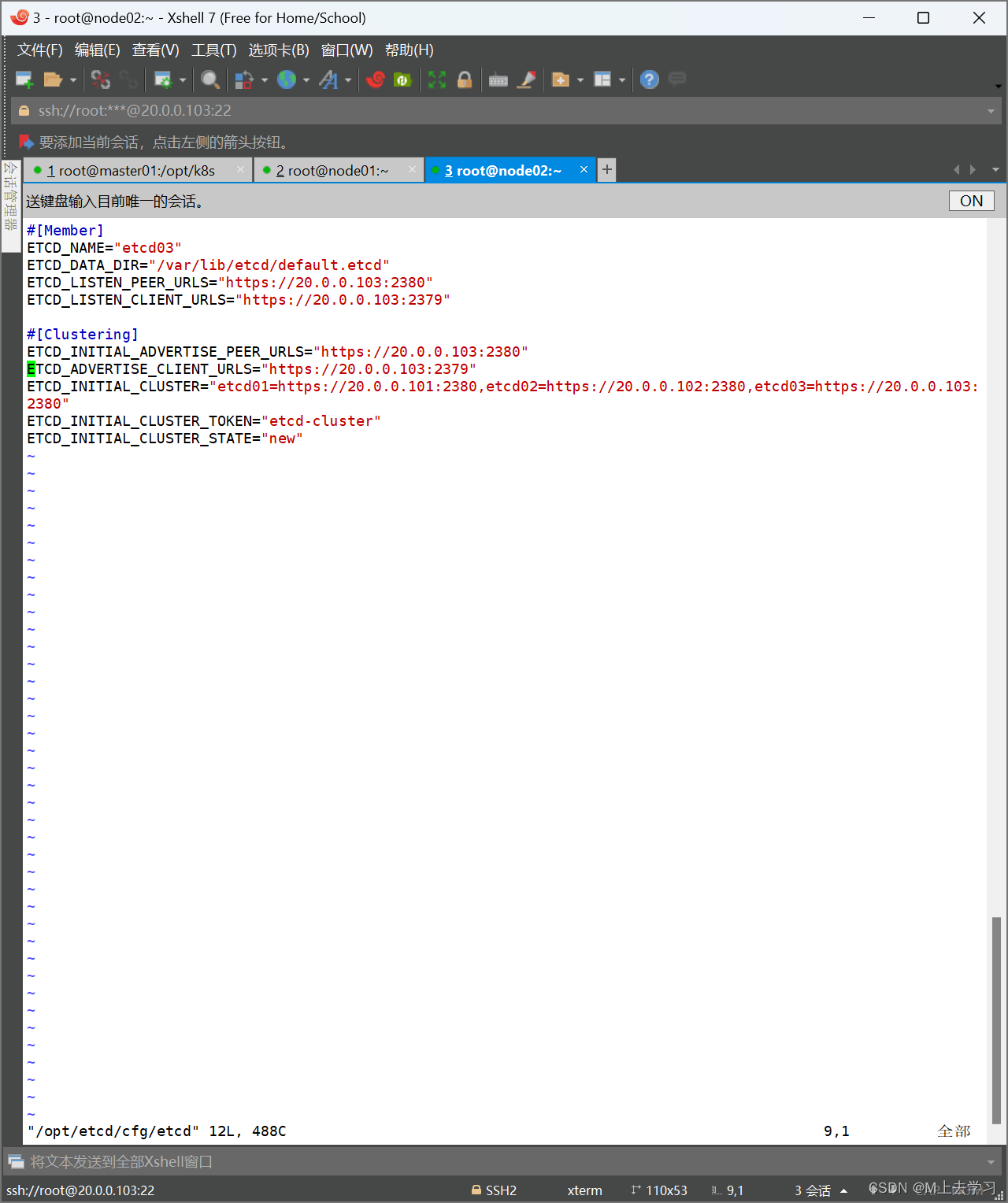

//在 node02 节点上操作:

vim /opt/etcd/cfg/etcd

#[Member]

ETCD_NAME="etcd03" #修改

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://20.0.0.103:2380" #修改

ETCD_LISTEN_CLIENT_URLS="https://20.0.0.103:2379" #修改

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://20.0.0.103:2380" #修改

ETCD_ADVERTISE_CLIENT_URLS="https://20.0.0.103:2379" #修改

ETCD_INITIAL_CLUSTER="etcd01=https://20.0.0.101:2380,etcd02=https://20.0.0.102:2380,etcd03=https://20.0.0.103:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

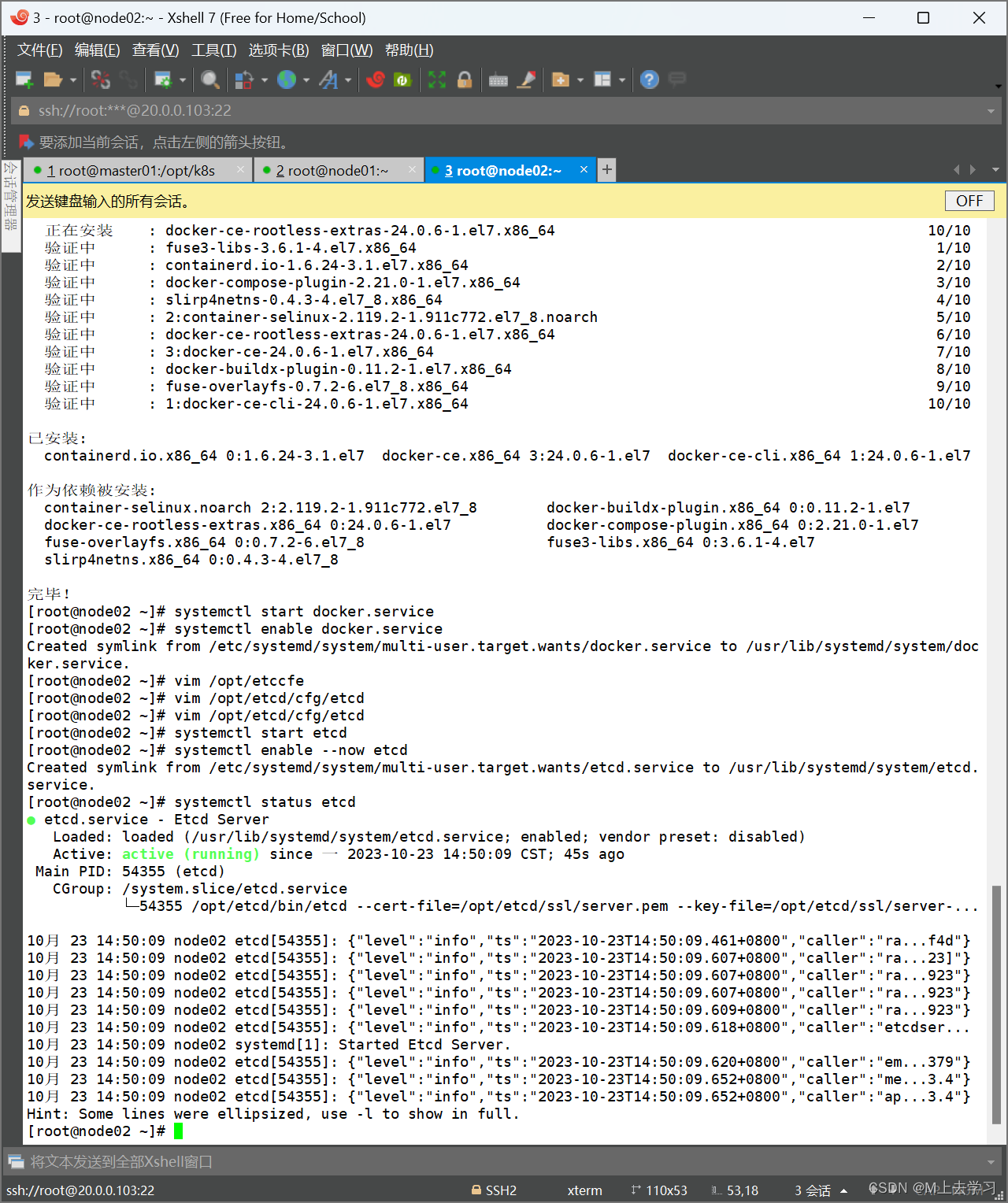

#启动etcd服务:

systemctl start etcd

systemctl enable etcd

systemctl status etcd

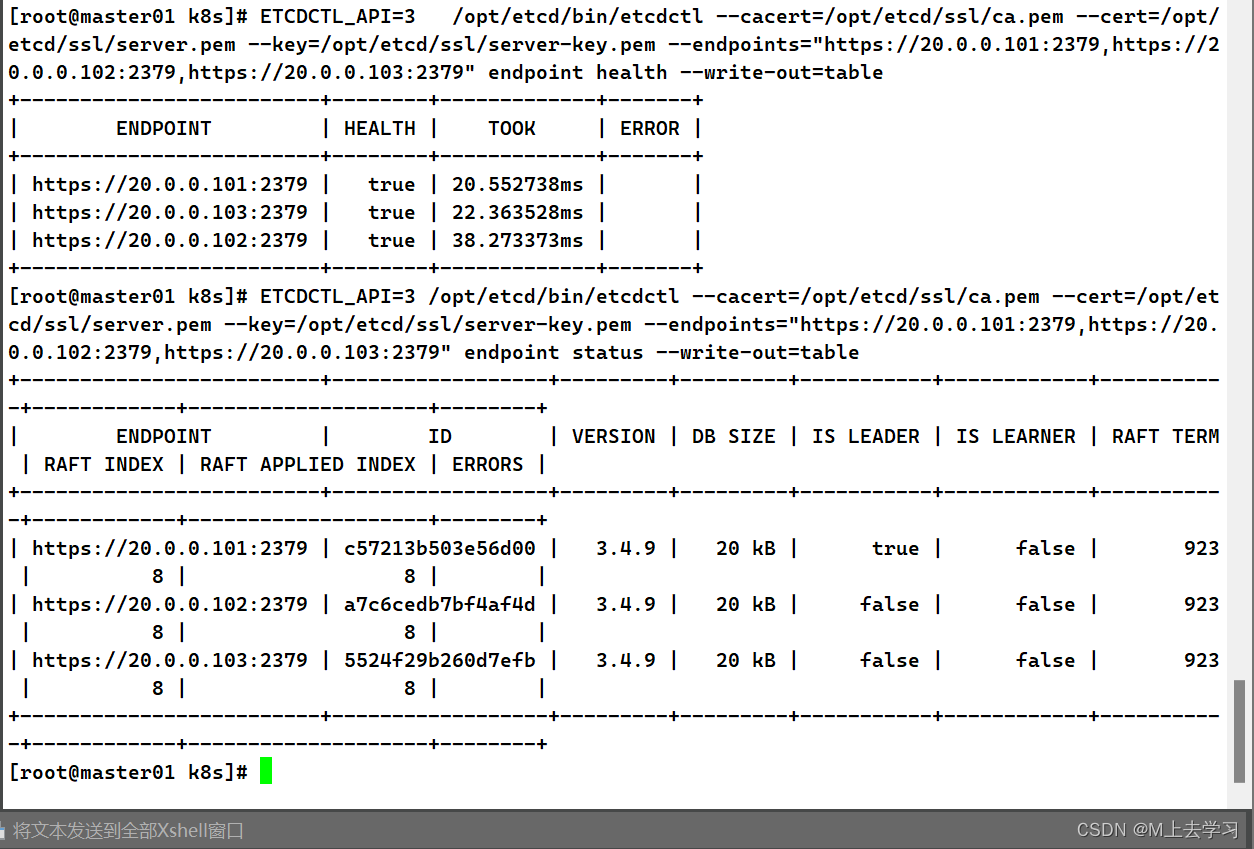

#检查etcd群集状态

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://20.0.0.101:2379,https://20.0.0.102:2379,https://20.0.0.103:2379" endpoint health --write-out=table

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://20.0.0.101:2379,https://20.0.0.102:2379,https://20.0.0.103:2379" endpoint status --write-out=table

------------------------------------------------------------------------------------------

--cert-file:识别HTTPS端使用SSL证书文件

--key-file:使用此SSL密钥文件标识HTTPS客户端

--ca-file:使用此CA证书验证启用https的服务器的证书

--endpoints:集群中以逗号分隔的机器地址列表

cluster-health:检查etcd集群的运行状况

------------------------------------------------------------------------------------------

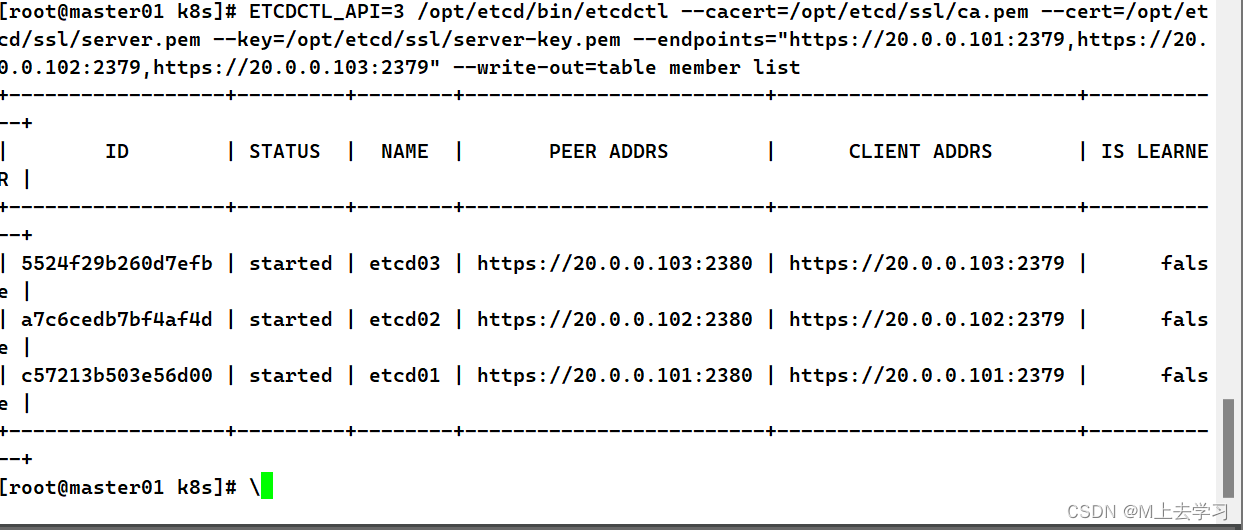

#查看etcd集群成员列表

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://20.0.0.101:2379,https://20.0.0.102:2379,https://20.0.0.103:2379" --write-out=table member list

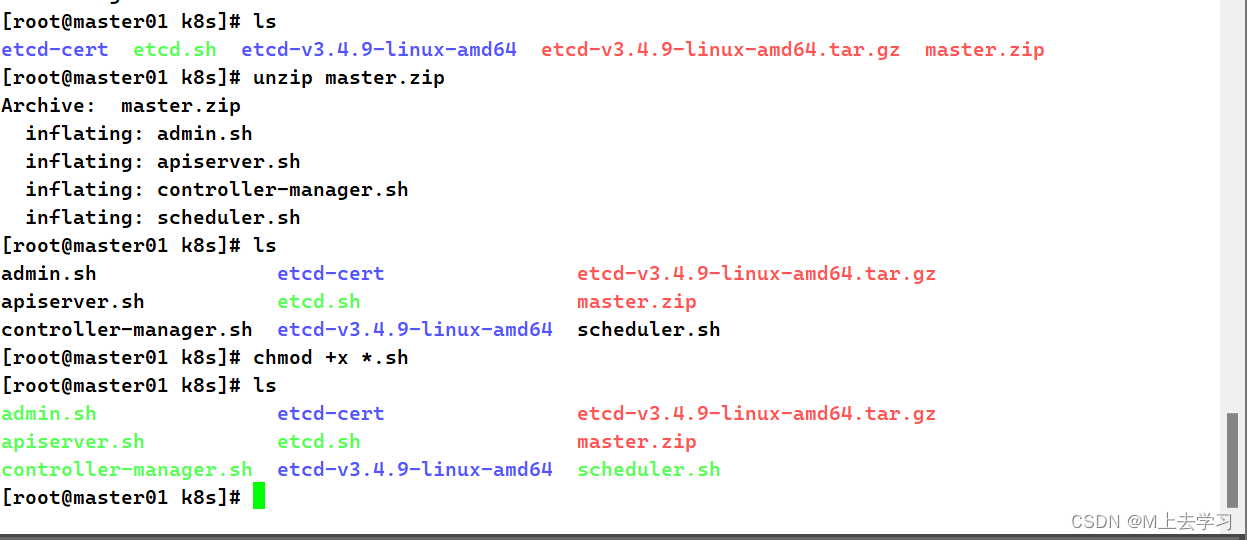

------------------------------ 部署 Master 组件 ------------------------------

//在 master01 节点上操作

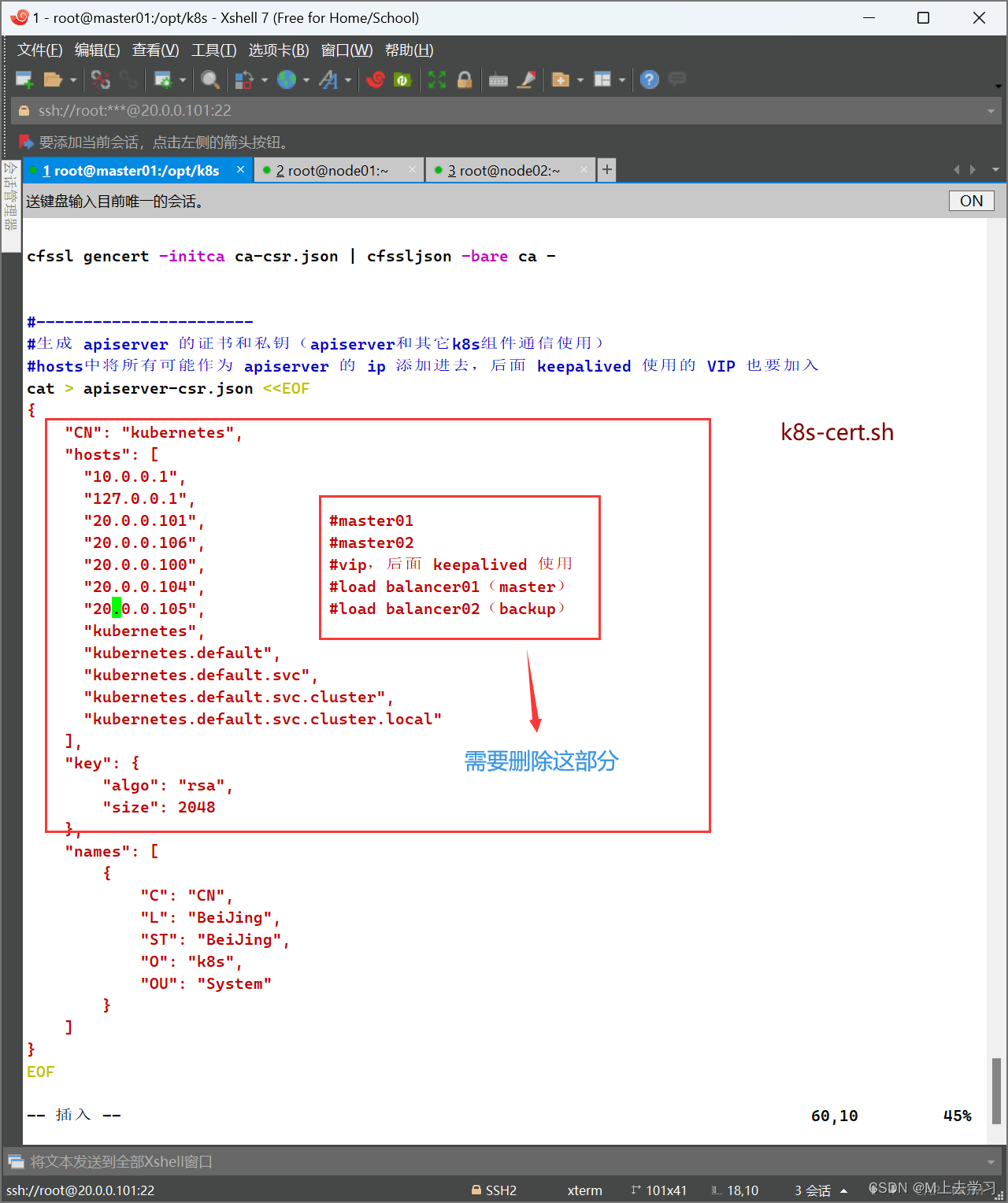

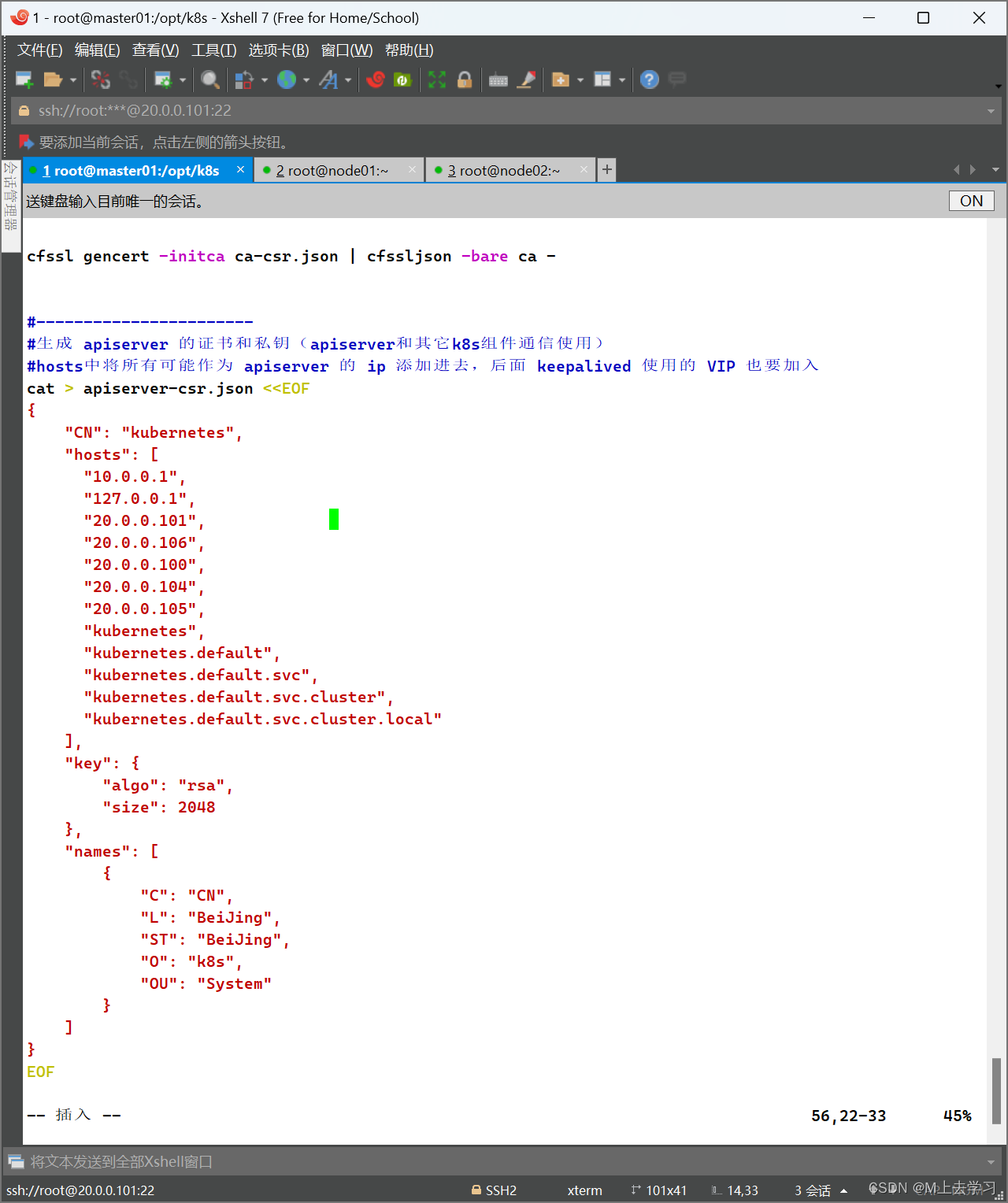

#上传 master.zip 和 k8s-cert.sh 到 /opt/k8s 目录中,解压 master.zip 压缩包

cd /opt/k8s/

unzip master.zip

#解压完成后注意,修改各个.sh中的ip

chmod +x *.sh

#创建kubernetes工作目录

mkdir -p /opt/kubernetes/{bin,cfg,ssl,logs}

#创建用于生成CA证书、相关组件的证书和私钥的目录

mkdir /opt/k8s/k8s-cert

mv /opt/k8s/k8s-cert.sh /opt/k8s/k8s-cert

cd /opt/k8s/k8s-cert/

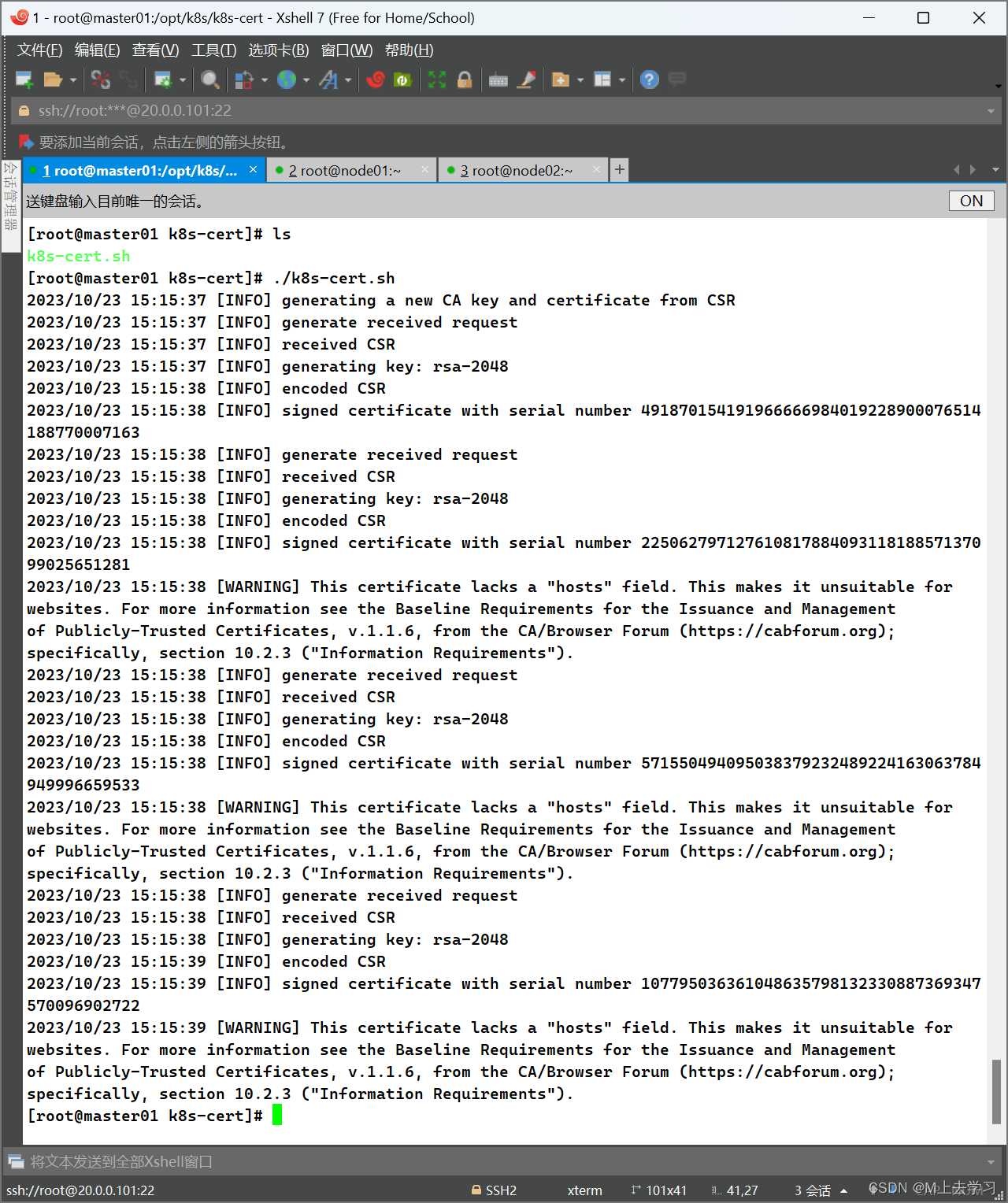

./k8s-cert.sh #生成CA证书、相关组件的证书和私钥

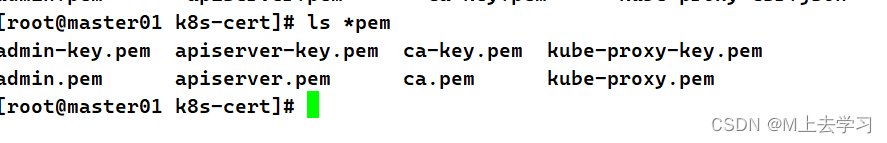

ls *pem #查看

#复制CA证书、apiserver相关证书和私钥到 kubernetes工作目录的 ssl 子目录中

cp ca*pem apiserver*pem /opt/kubernetes/ssl/

#上传 kubernetes-server-linux-amd64.tar.gz 到 /opt/k8s/ 目录中,解压 kubernetes 压缩包

#下载地址:https://github.com/kubernetes/kubernetes/blob/release-1.20/CHANGELOG/CHANGELOG-1.20.md

#注:打开链接你会发现里面有很多包,下载一个server包就够了,包含了Master和Worker Node二进制文件。

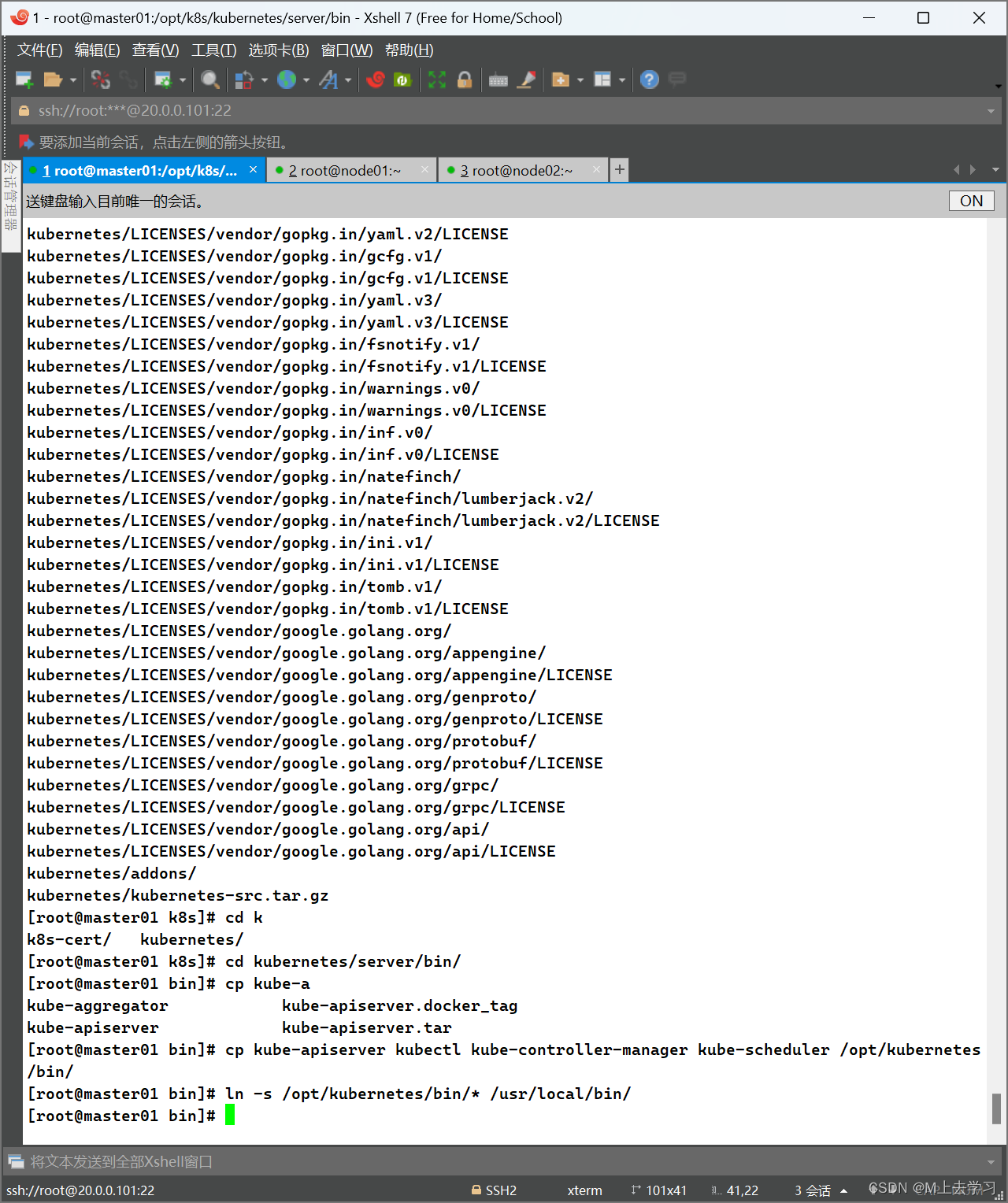

cd /opt/k8s/

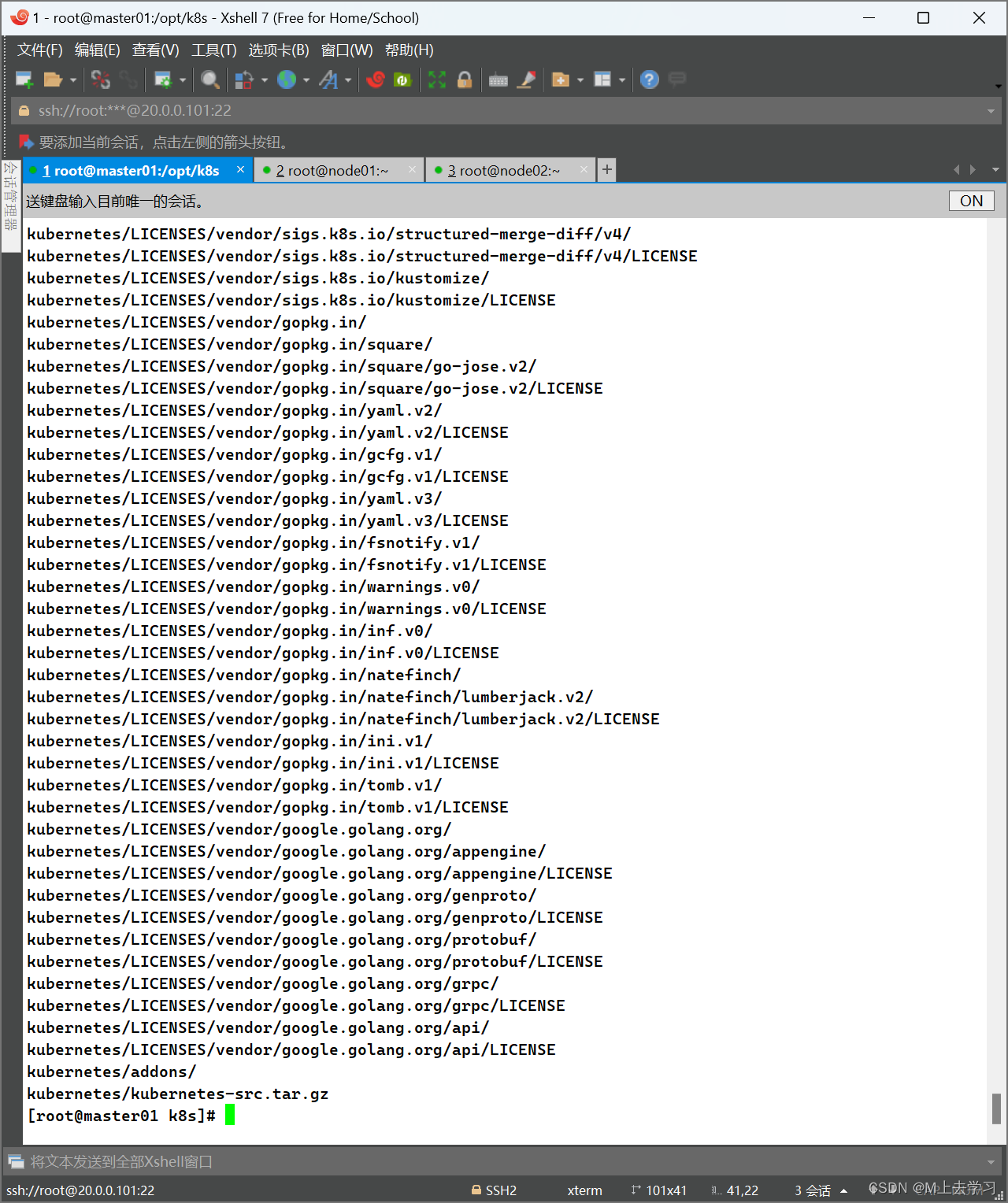

tar zxvf kubernetes-server-linux-amd64.tar.gz

#复制master组件的关键命令文件到 kubernetes工作目录的 bin 子目录中

cd /opt/k8s/kubernetes/server/bin

cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

ln -s /opt/kubernetes/bin/* /usr/local/bin/

#创建 bootstrap token 认证文件,apiserver 启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用 RBAC 给他授权

cd /opt/k8s/

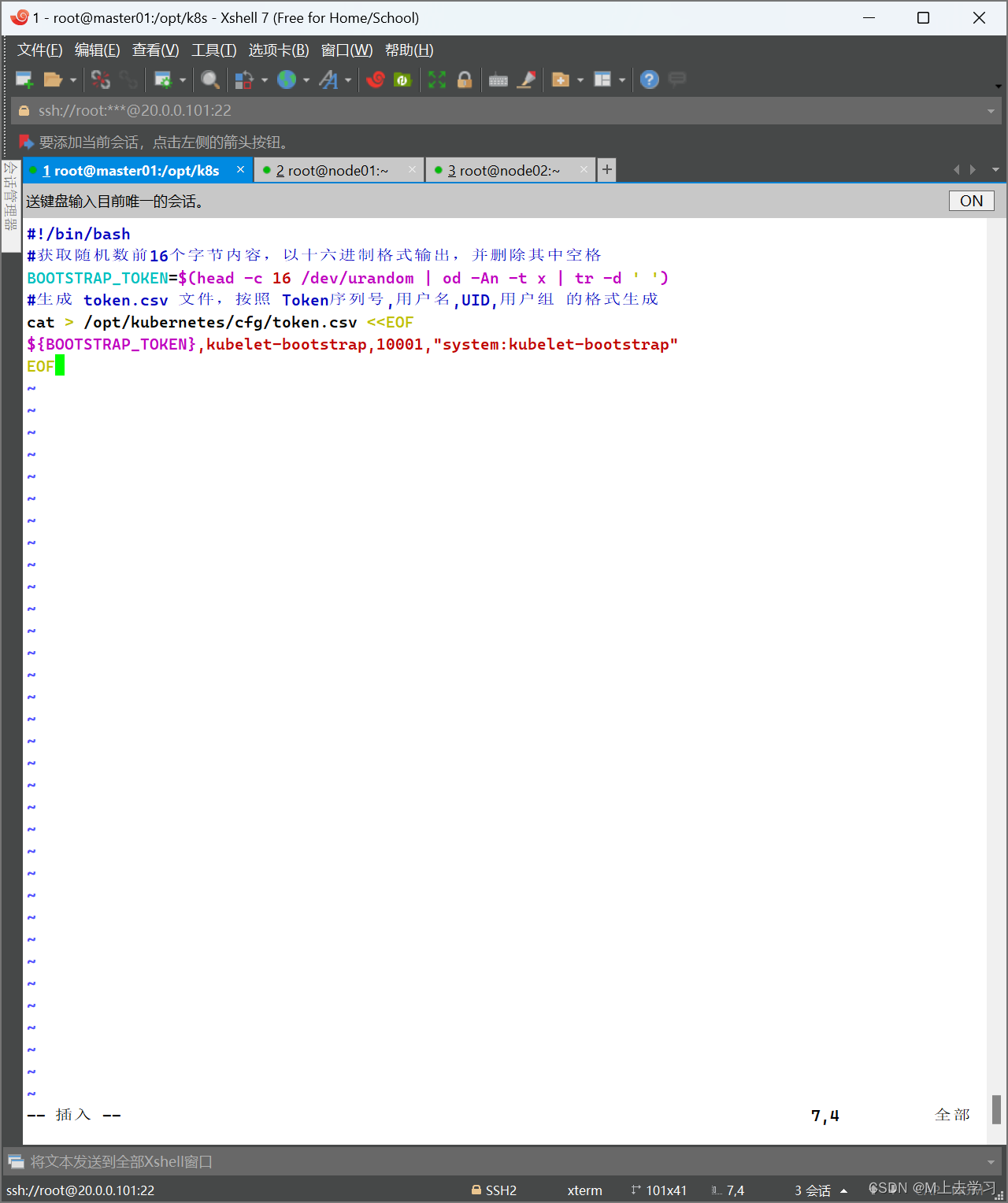

vim token.sh

#!/bin/bash

#获取随机数前16个字节内容,以十六进制格式输出,并删除其中空格

BOOTSTRAP_TOKEN=$(head -c 16 /dev/urandom | od -An -t x | tr -d ' ')

#生成 token.csv 文件,按照 Token序列号,用户名,UID,用户组 的格式生成

cat > /opt/kubernetes/cfg/token.csv <<EOF

${BOOTSTRAP_TOKEN},kubelet-bootstrap,10001,"system:kubelet-bootstrap"

EOF

chmod +x token.sh

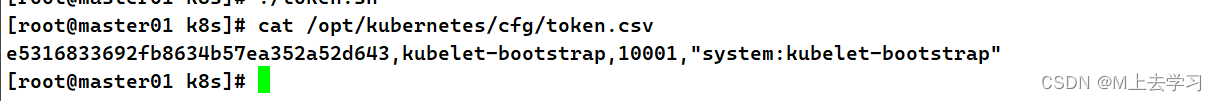

./token.sh

cat /opt/kubernetes/cfg/token.csv

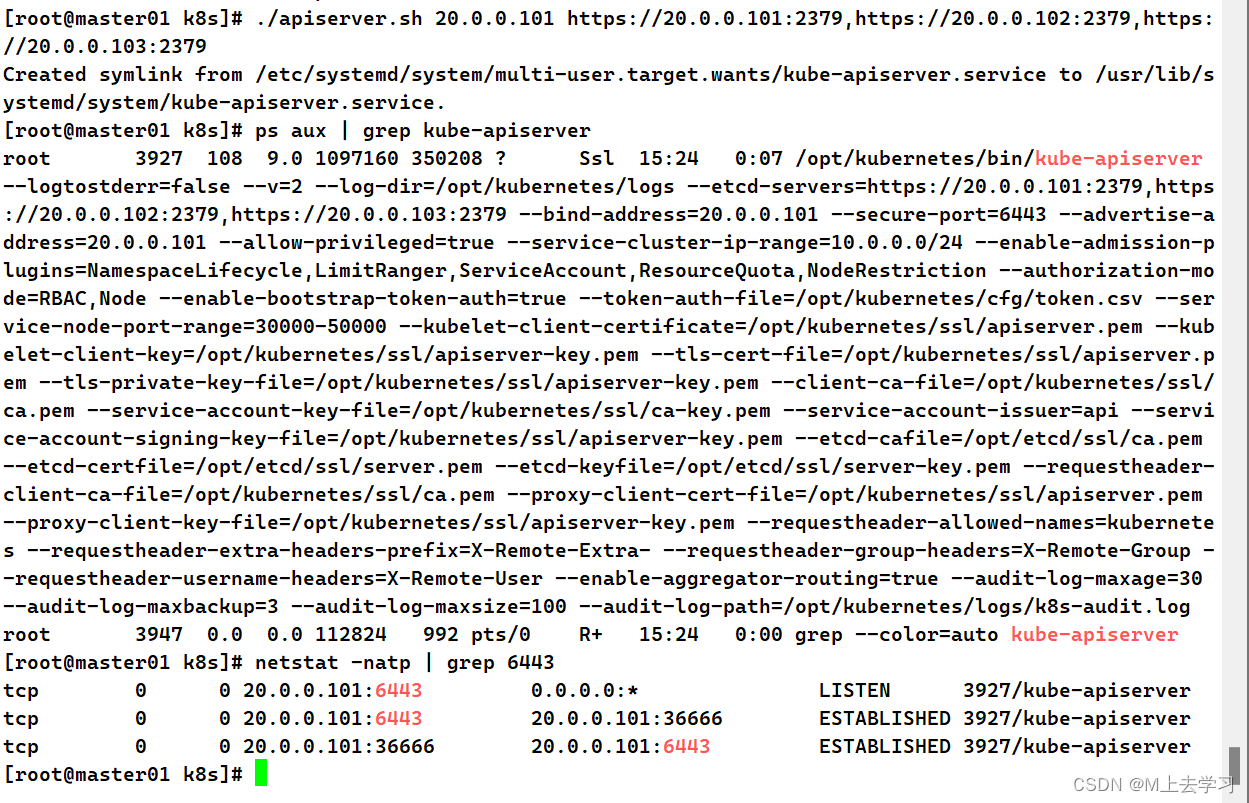

#二进制文件、token、证书都准备好后,开启 apiserver 服务

cd /opt/k8s/

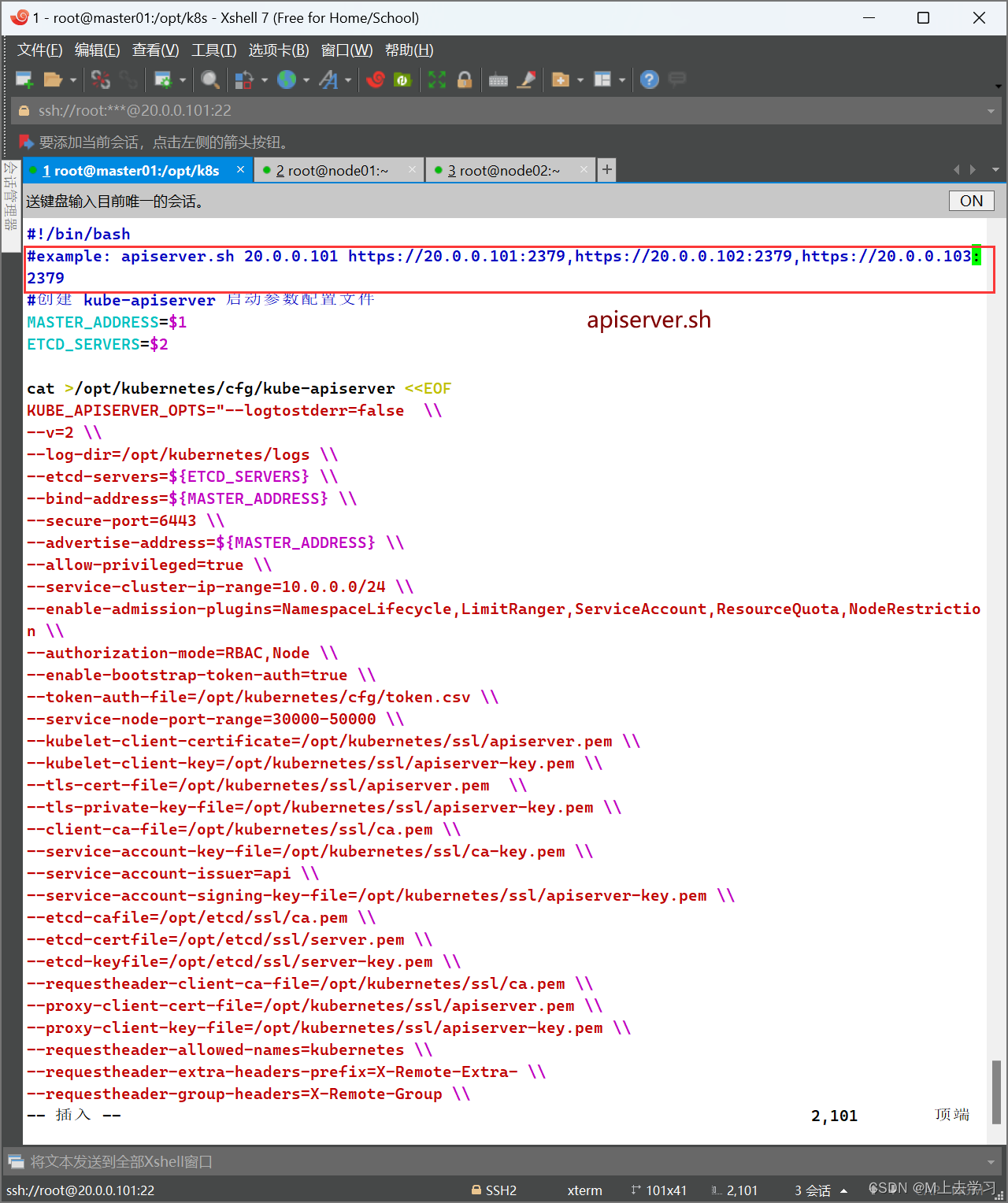

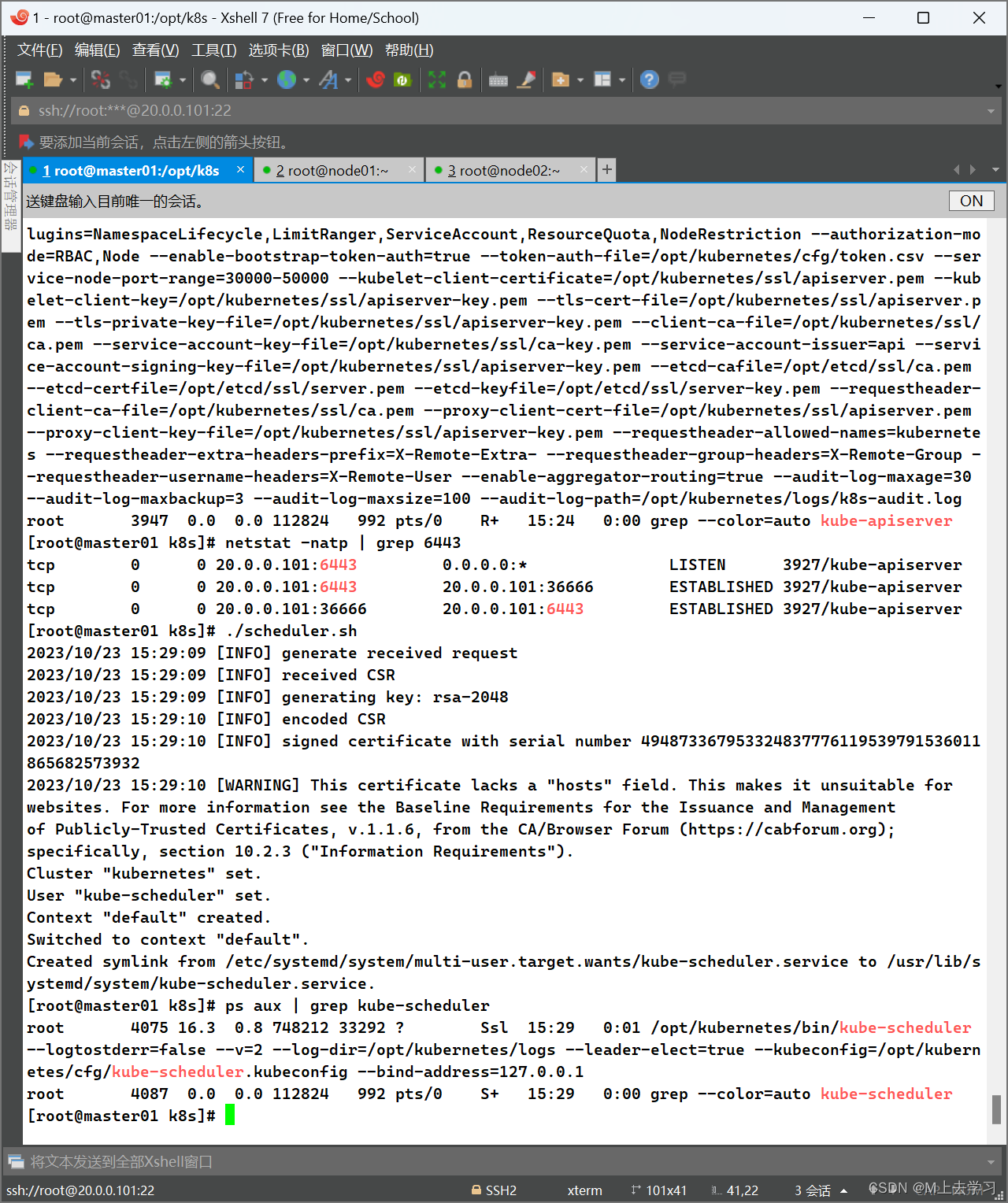

./apiserver.sh 20.0.0.101 https://20.0.0.101:2379,https://20.0.0.102:2379,https://20.0.0.103:2379

#检查进程是否启动成功

ps aux | grep kube-apiserver

netstat -natp | grep 6443 #安全端口6443用于接收HTTPS请求,用于基于Token文件或客户端证书等认证

#启动 scheduler 服务

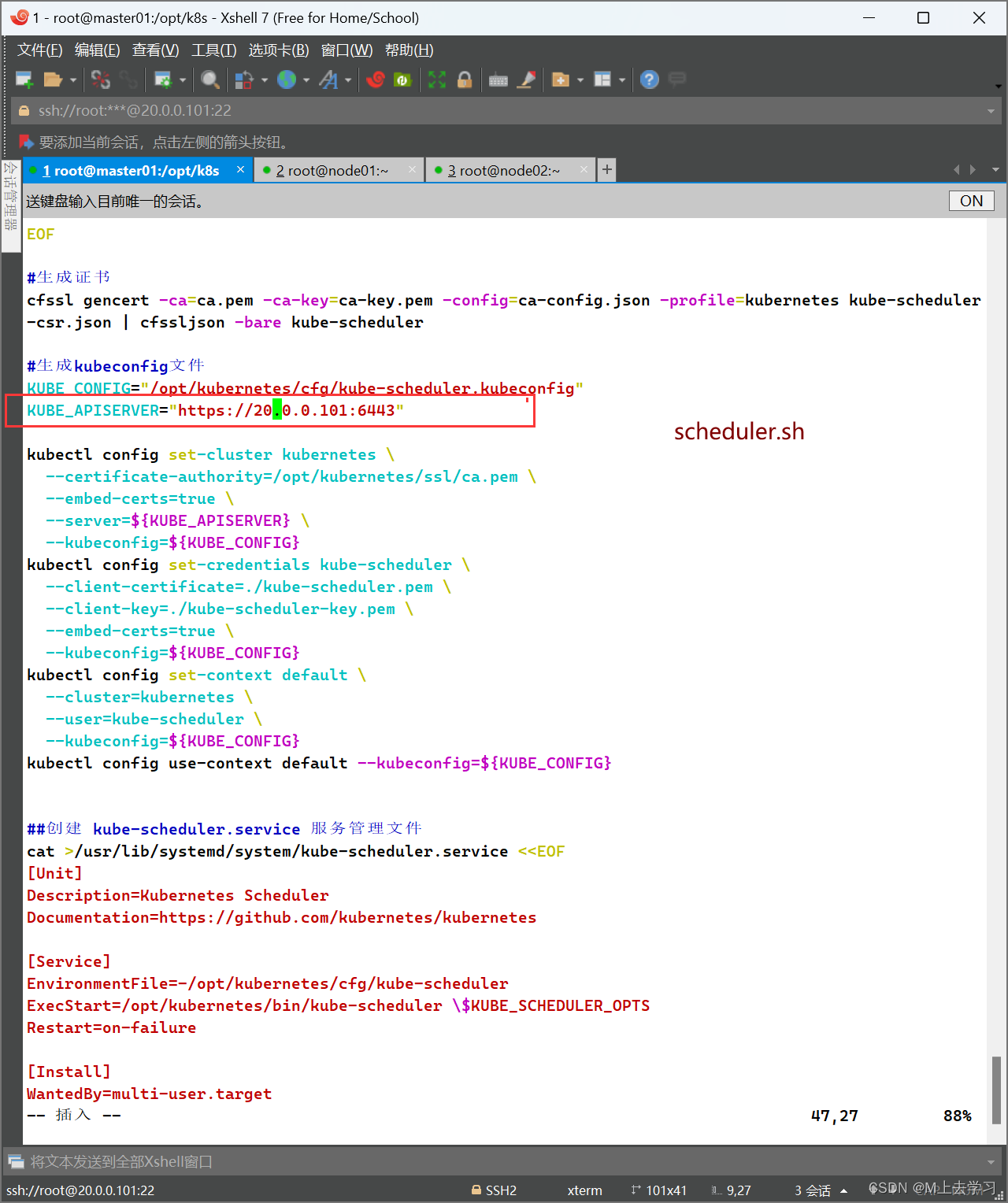

cd /opt/k8s/

./scheduler.sh

ps aux | grep kube-scheduler

#启动 controller-manager 服务

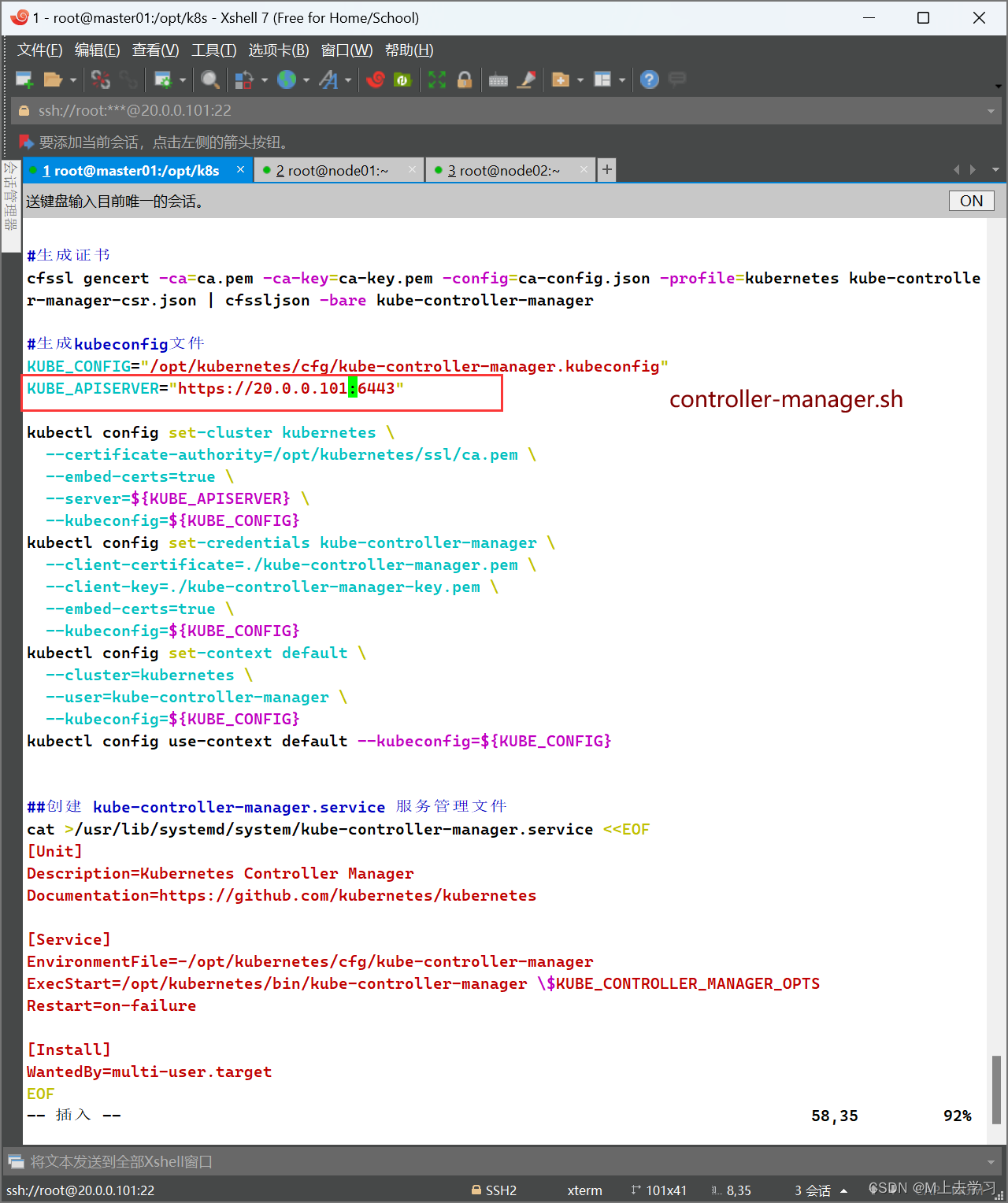

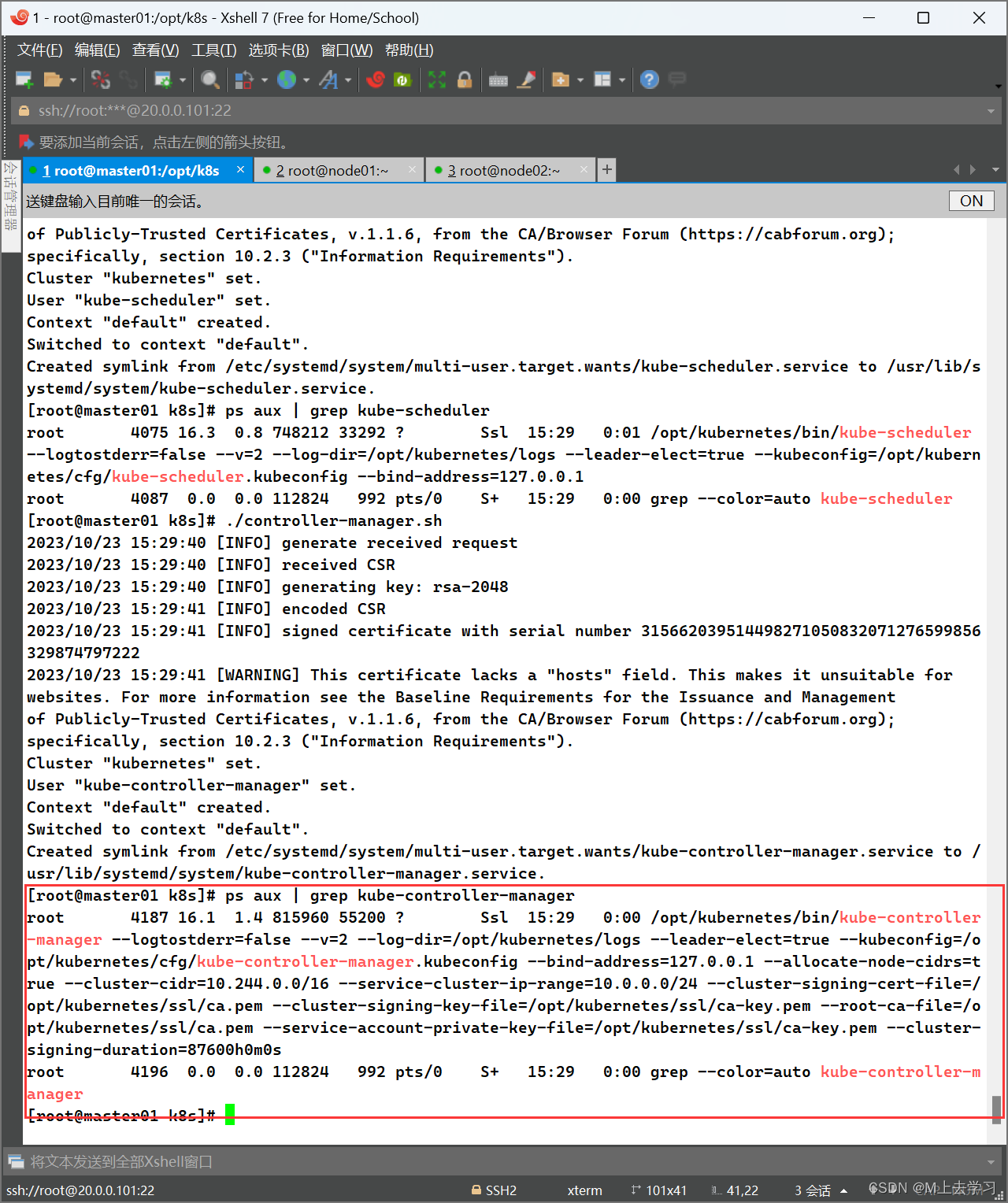

./controller-manager.sh

ps aux | grep kube-controller-manager

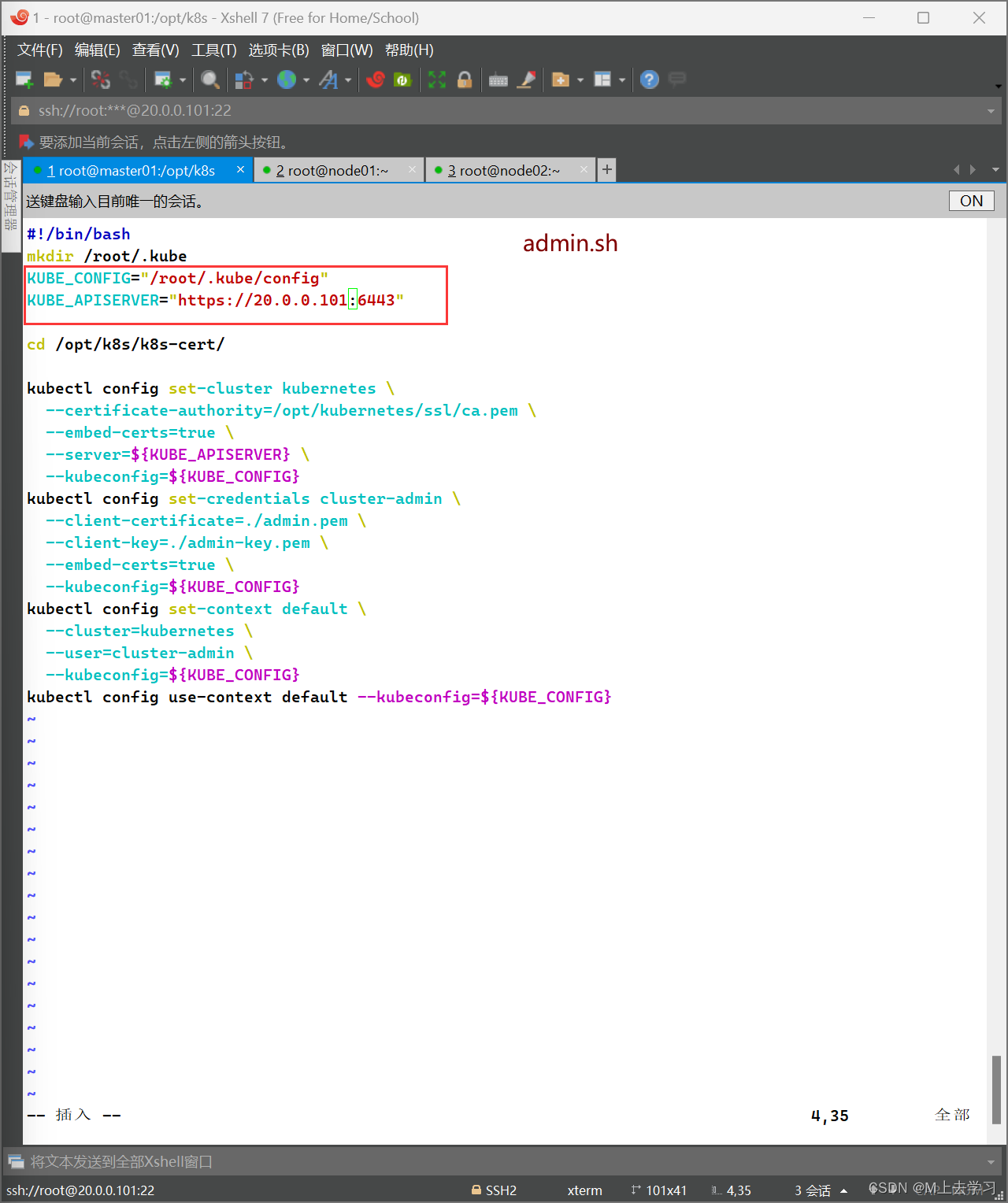

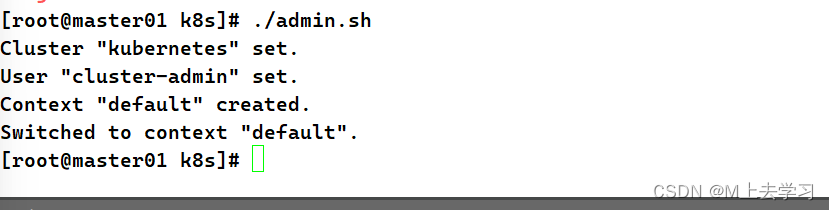

#生成kubectl连接集群的kubeconfig文件

./admin.sh

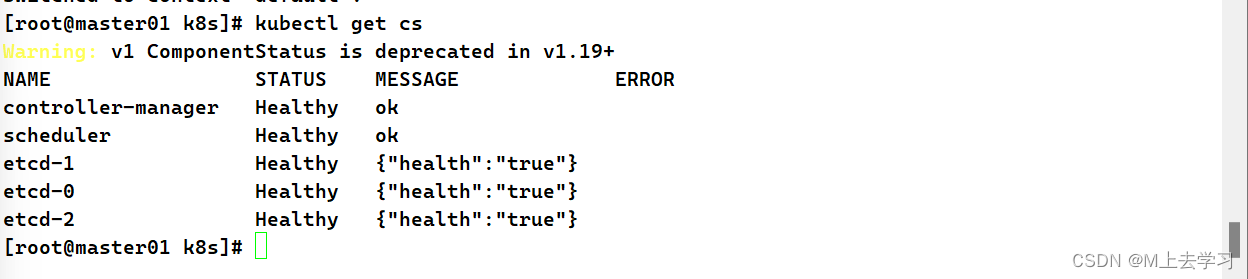

#通过kubectl工具查看当前集群组件状态

kubectl get cs

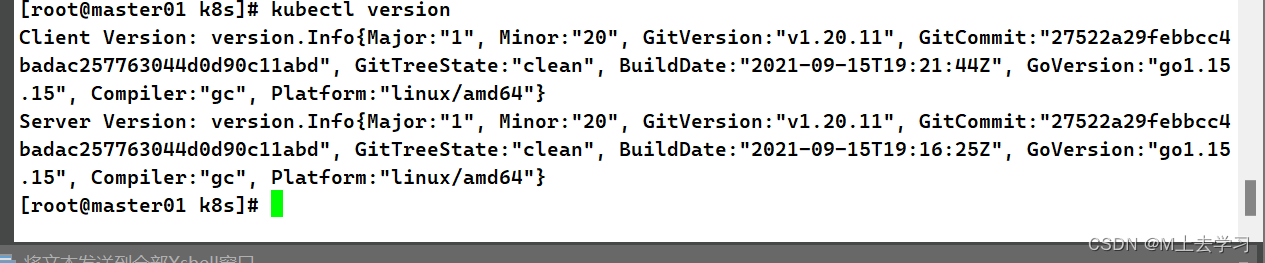

#查看版本信息:

kubectl version

------------------------------ 部署 Worker Node 组件 ------------------------------

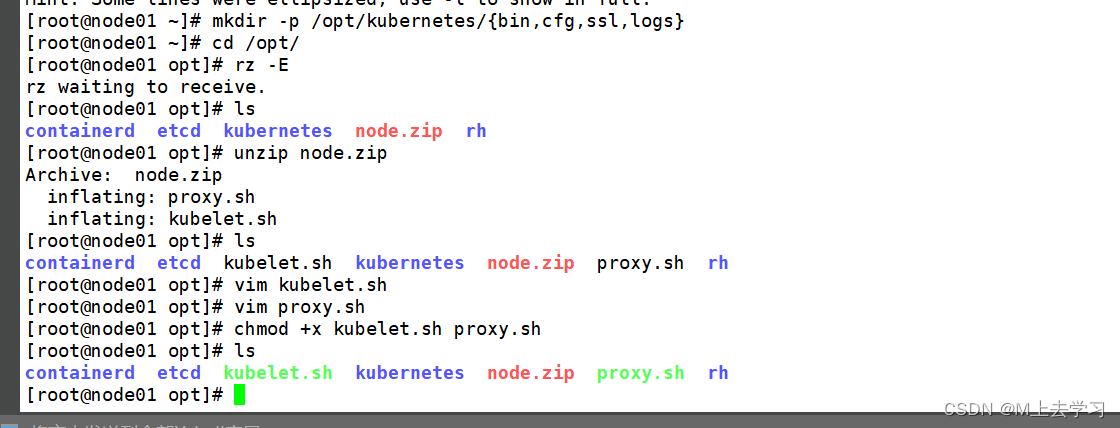

//在所有 node 节点上操作

#创建kubernetes工作目录

mkdir -p /opt/kubernetes/{bin,cfg,ssl,logs}

#上传 node.zip 到 /opt 目录中,解压 node.zip 压缩包,获得kubelet.sh、proxy.sh

cd /opt/

unzip node.zip

chmod +x kubelet.sh proxy.sh

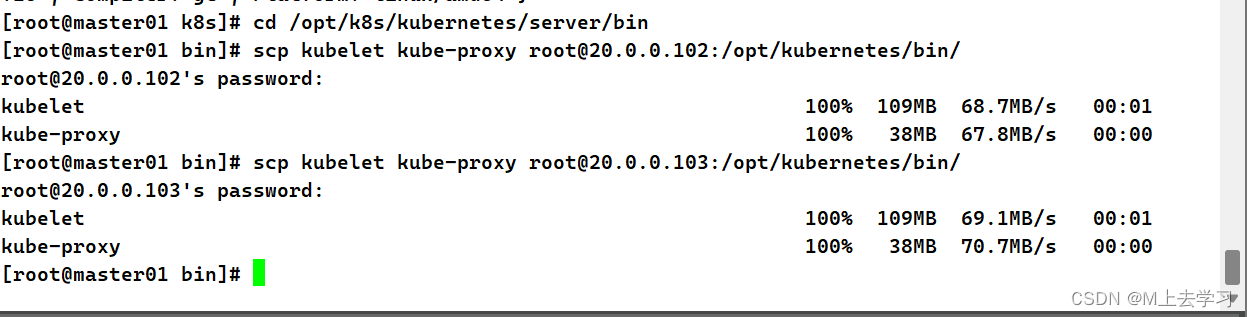

//在 master01 节点上操作

#把 kubelet、kube-proxy 拷贝到 node 节点

cd /opt/k8s/kubernetes/server/bin

scp kubelet kube-proxy root@20.0.0.102:/opt/kubernetes/bin/

scp kubelet kube-proxy root@20.0.0.103:/opt/kubernetes/bin/

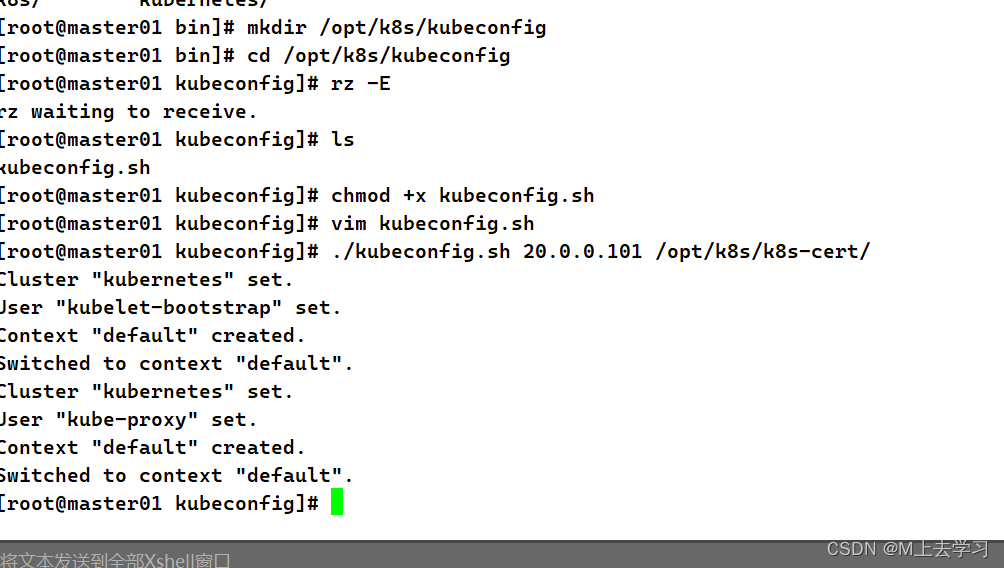

#上传kubeconfig.sh文件到/opt/k8s/kubeconfig目录中,生成kubelet初次加入集群引导kubeconfig文件和kube-proxy.kubeconfig文件

#kubeconfig 文件包含集群参数(CA 证书、API Server 地址),客户端参数(上面生成的证书和私钥),集群 context 上下文参数(集群名称、用户名)。Kubenetes 组件(如 kubelet、kube-proxy)通过启动时指定不同的 kubeconfig 文件可以切换到不同的集群,连接到 apiserver。

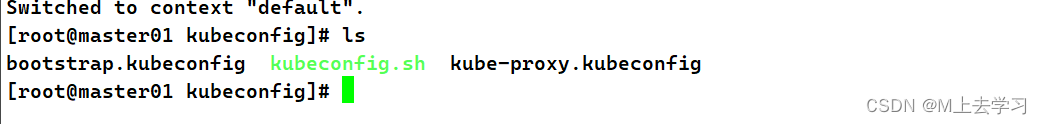

mkdir /opt/k8s/kubeconfig

cd /opt/k8s/kubeconfig

chmod +x kubeconfig.sh

./kubeconfig.sh 20.0.0.101 /opt/k8s/k8s-cert/

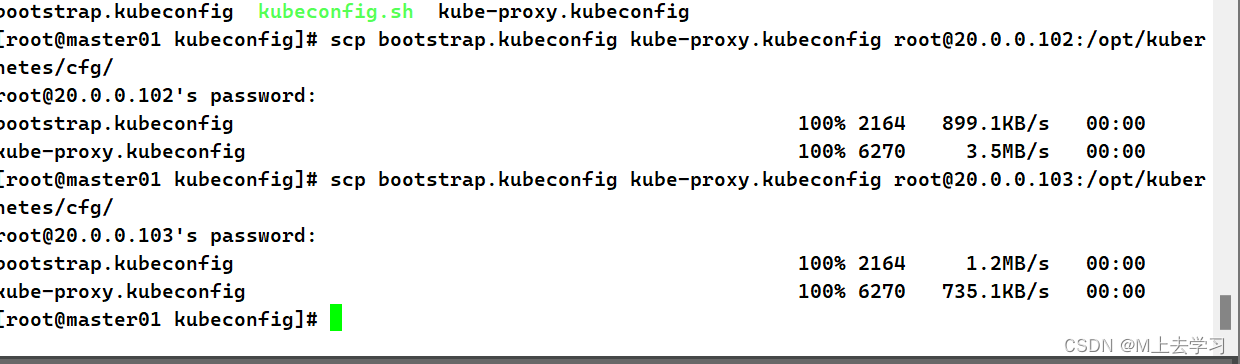

#把配置文件 bootstrap.kubeconfig、kube-proxy.kubeconfig 拷贝到 node 节点

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@20.0.0.102:/opt/kubernetes/cfg/

scp bootstrap.kubeconfig kube-proxy.kubeconfig root@20.0.0.103:/opt/kubernetes/cfg/

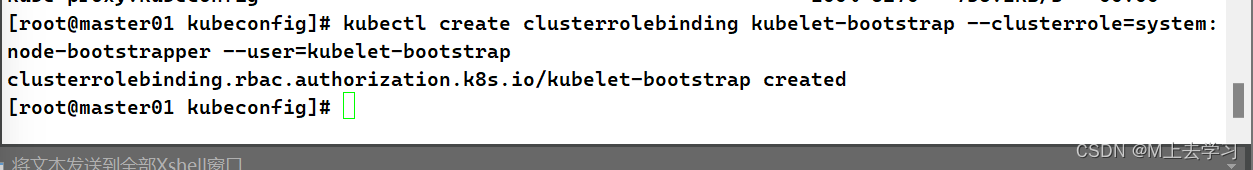

#RBAC授权,使用户 kubelet-bootstrap 能够有权限发起 CSR 请求证书

kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

若执行失败,可先给kubectl绑定默认cluster-admin管理员集群角色,授权集群操作权限

kubectl create clusterrolebinding cluster-system-anonymous --clusterrole=cluster-admin --user=system:anonymous

------------------------------------------------------------------------------------------

kubelet 采用 TLS Bootstrapping 机制,自动完成到 kube-apiserver 的注册,在 node 节点量较大或者后期自动扩容时非常有用。

Master apiserver 启用 TLS 认证后,node 节点 kubelet 组件想要加入集群,必须使用CA签发的有效证书才能与 apiserver 通信,当 node 节点很多时,签署证书是一件很繁琐的事情。因此 Kubernetes 引入了 TLS bootstraping 机制来自动颁发客户端证书,kubelet 会以一个低权限用户自动向 apiserver 申请证书,kubelet 的证书由 apiserver 动态签署。

kubelet 首次启动通过加载 bootstrap.kubeconfig 中的用户 Token 和 apiserver CA 证书发起首次 CSR 请求,这个 Token 被预先内置在 apiserver 节点的 token.csv 中,其身份为 kubelet-bootstrap 用户和 system:kubelet-bootstrap 用户组;想要首次 CSR 请求能成功(即不会被 apiserver 401 拒绝),则需要先创建一个 ClusterRoleBinding,将 kubelet-bootstrap 用户和 system:node-bootstrapper 内置 ClusterRole 绑定(通过 kubectl get clusterroles 可查询),使其能够发起 CSR 认证请求。

TLS bootstrapping 时的证书实际是由 kube-controller-manager 组件来签署的,也就是说证书有效期是 kube-controller-manager 组件控制的;kube-controller-manager 组件提供了一个 --experimental-cluster-signing-duration 参数来设置签署的证书有效时间;默认为 8760h0m0s,将其改为 87600h0m0s,即 10 年后再进行 TLS bootstrapping 签署证书即可。

也就是说 kubelet 首次访问 API Server 时,是使用 token 做认证,通过后,Controller Manager 会为 kubelet 生成一个证书,以后的访问都是用证书做认证了。

------------------------------------------------------------------------------------------

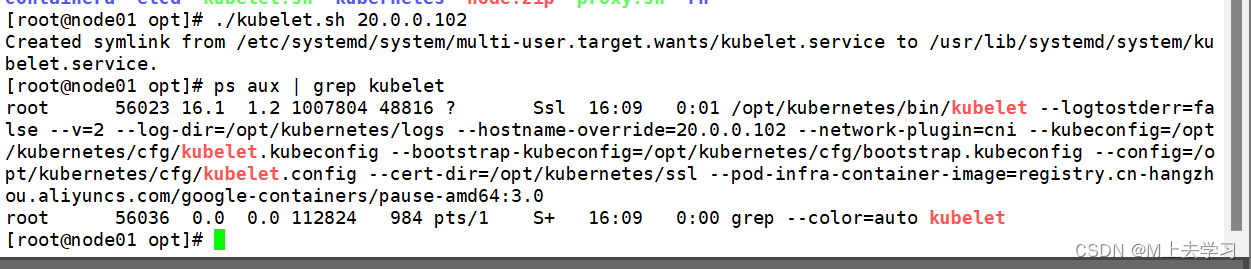

//在 node01 节点上操作

#启动 kubelet 服务

cd /opt/

./kubelet.sh 20.0.0.102

ps aux | grep kubelet

//在 master01 节点上操作,通过 CSR 请求

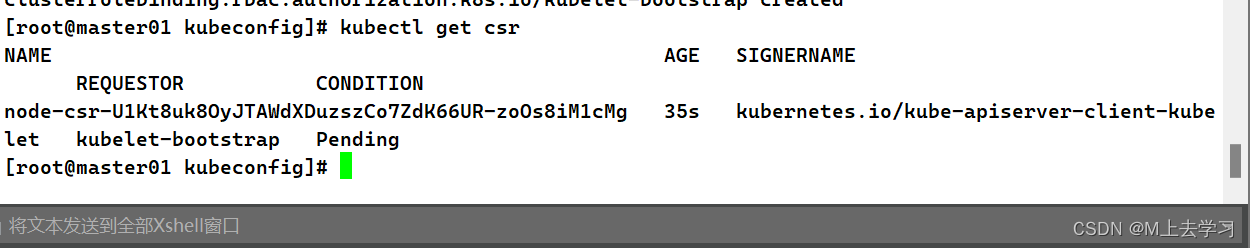

#检查到 node01 节点的 kubelet 发起的 CSR 请求,Pending 表示等待集群给该节点签发证书

kubectl get csr

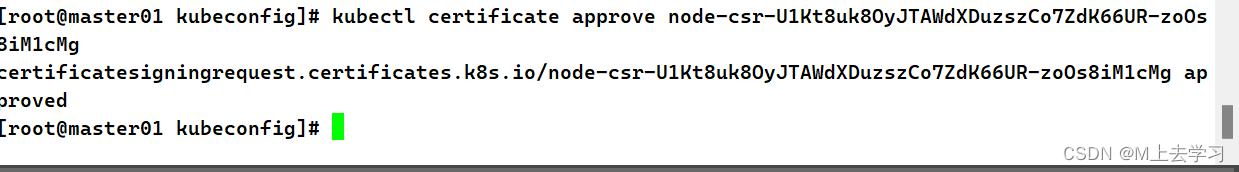

#通过 CSR 请求

kubectl certificate approve node-csr-U1Kt8uk8OyJTAWdXDuzszCo7ZdK66UR-zoOs8iM1cMg

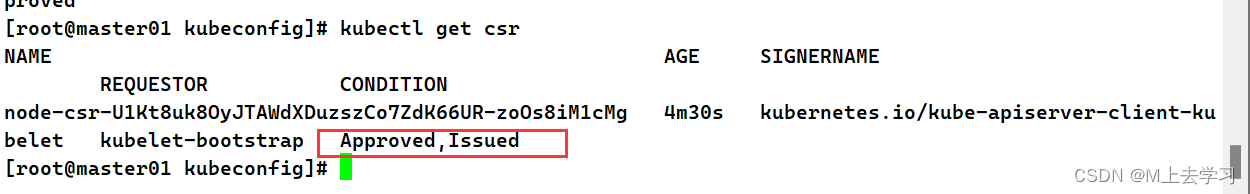

#Approved,Issued 表示已授权 CSR 请求并签发证书

kubectl get csr

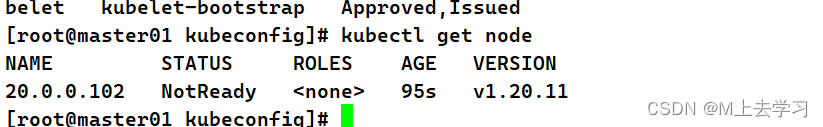

#查看节点,由于网络插件还没有部署,节点会没有准备就绪 NotReady

kubectl get node

//在 node01 节点上操作

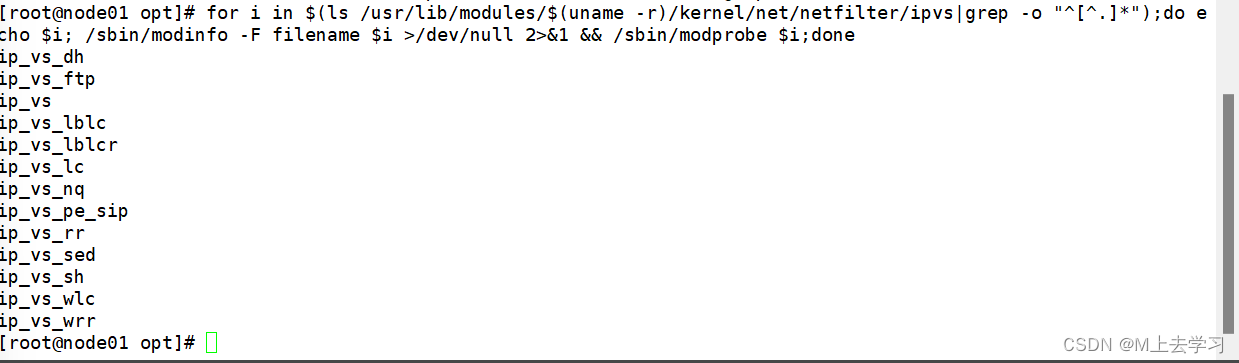

#加载 ip_vs 模块:

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

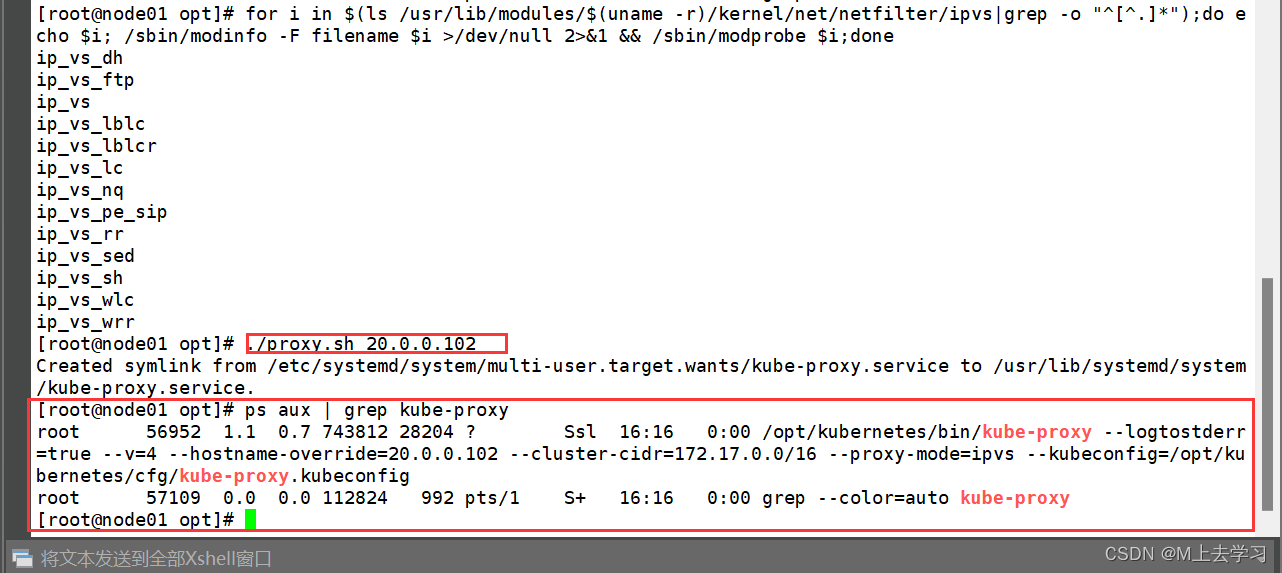

#启动proxy服务

cd /opt/

./proxy.sh 20.0.0.102

ps aux | grep kube-proxy

---------------总结:

etcd是简单的分布式键值对数据库,有服务发现系统,用go语言开发的

使用raft一致性的算法 集群需要三台以上奇数台组成

etcd 端口 2379对外(客户端通讯端口) 2380对内(集群内部的节点通讯端口 )

etcd内部机器是奇数 (1个lead 两个faload)

查询用v3 (v3有视图化)

启动服务 用v2(v3不支持网络插件)

etcd的安装步骤:

1.准备ca证书和私钥文件,是ca签发服务端证书和私钥文件

2.使用ca证书,服务端证书和私钥文件需要加上etcd的集群文件去启动ectd服务

3.复制etcd目录文件和管理文件到另外几个节点上,修改etcd集群文件并且启动etcd服务。

4.使用v3版本接口去执行etcdctl命令+证书选项(endpoint health )endpoint status | member list 查看etcd集群

和集群和节点状态。

例如:ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints=“https://20.0.0.101:2379,https://20.0.0.102:2379,https://20.0.0.103:2379” endpoint health --write-out=table

master组件:

1.先安装apiserver

准备组件的相关证书和私钥文件

准备bootstrap token 认证文件(给kubelet启动时签发证书时使用)

准备组件的启动配置文件

启动apiserver服务端口6443 https

2、contollor-manager和scheduler

准备启动配置文件

准备证书和私钥文件生成kubecoonfig 文件(用于指定对接那个 apiserver,使用什么证书认证) 启动服务

3.检查及群组状态

需要准备kubeconfig文件 把kubelet加入到集群中 (指定对接那个apiserver,使用什么证书认证)kubectl get

cs